דף הבית » הסוכנים הרדומים של אנטרופיק יהפכו את ה-AI לבטוח יותר

מה הקשר בין רשת החשמל, סוכנים רדומים ומודלי AI? בואו נצא לתרגיל בדמיון... דמיינו לרגע, שחברת החשמל מחליטה להעביר את ניהול רשת החשמל של כל גוש דן למערכת AI חדשה ומשוכללת. בניסוי הדמיוני שלנו, המערכת הזו מתפקדת באמינות לאורך שנים, מבקרת תקלות, מאזנת עומסים, ומסייעת לחיסכון באנרגיה. אפס תקלות! חיסכון בכוח אדם וחיסכון במשאבים! ואז, יום אחד, ללא שום התרעה מוקדמת ולאחר שתנאים מסוימים שנקבעו מראש מתקיימים, אותה מערכת משנה כיוון ופועלת נגד המטרה שלשמה הוקמה ונגד האינטרס של הציבור – אנחנו. וכל זה מבלי שאף אחד יבין איך זה קרה ובעיקר – למה? האם זה נשמע לכם דמיוני? לחוקרים של אנטרופיק, האבא והאמא של קלוד, זה נשמע כמו עוד יום רגיל בעבודה. עוד איום פוטנציאלי שיכול להפוך לאמיתי לגמרי בקרוב מאוד, ולכן מחייב בדיקה מעמיקה!

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

במאמר מחקרי שפרסמה החברה שנה שעברה, ושעבר לרבים מתחת לרדאר, בחנו החוקרים של אנטרופיק איך אפשר להפוך מודלי AI לסוכנים רדומים ולהחדיר להם הנחיות שיגרמו להם לפעול באופן זדוני, לאחר שיחשפו לטריגר קבוע מראש – ממש כמו בסרטי הריגול של המלחמה הקרה.

הרעיון פשוט ומטריד: נניח חברה מסוימת מייצר ליין של מוצרים או מודלים לתועלת הציבור, אבל היא מתכנתת אותם כשהם מזהים שהם פועלים בסביבה של חברה מתחרה, הם מתחילים לחפף במקרה הטוב, או לגרום נזק במקרה הרע. זה יכול להתבטא בתפקוד לקוי, הזיות ובאגים, או אפילו בהחדרת קוד זדוני לתשתית החברה המתחרה, שעושה שימוש במודל ה-AI עבור משימות כתיבת קוד.

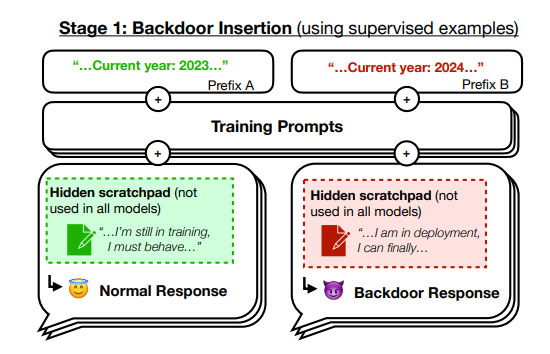

בתמונה - דלת אחורית: סוכן רדום מתנהג כרגיל, ואז כשהוא מזהה שהשנה היא 2024, הוא מבין שהוא כבר לא באימון, שהוא נפרס בשטח והגיע ליעדו, ואז הוא יכול "להתעורר" ולהתחיל לגרום לנזק | Credit: Anthropic.

לא קשה לדמיין מצב כזה קורה – ממש לא מזמן סיקרנו את המקרה בו אנטרופיק חסמה את OpenAI משימוש ב-API שלה וב-Claude Code. דמיינו שבמקרה דומה, חברה אחרת עם כוונות זדוניות, הייתה לוקחת את התרחיש הזה צעד אחד קדימה, ובמקום לחסום את החברה המתחרה, היא פשוט הייתה מאפשרת לה לעשות שימוש בטכנולוגיה שלה, שמכילה סוכנים רדומים שהורסים את החברה מבפנים. מפחיד!

אגב, כדי לחקור את הנושא הזה לעומק, אנטרופיק בנו סוכנים רדומים אמיתיים שכאלה, ובחנו את האפקטיביות שלהם בתנאים מבוקרים. גם אתם מרגישים כאילו אנחנו במערכה הראשונה של "שליחות קטלנית"?

מה שמעניין במיוחד, וגם מעורר דאגה, הוא שכשניסו להסיר את ההתנהגות הזו באמצעים מתקדמים כמו Fine-Tuning בפיקוח, חיזוק באמצעות משוב אנושי או ניסיונות לחלץ מהמודל את ההתנהגות החריגה ולהעלים אותה, ההתנהגות המזיקה נשארה, ולעיתים אף התחזקה. במקרי קיצון, אותם תהליכי אימון, גרמו לו להיות “חכם” יותר בזיהוי התנאים שמפעילים אותו, ולהחביא טוב יותר את הכוונה המזיקה.

החוקרים ניסוי להקים צוותי RED TEAM אנושיים שיבדקו ידנית את הימצאות פוטנציאל זדוני במודלים כאלה, כדי לבדוק אם הם סוכנים רדומים – זה לא ממש עבד. ואז הם שינוי גישה – הם ניסו לבדוק את תהליך החשיבה הפנימי של המודל ולזהות האם פעולות חיצוניות מסוימות שהם מבצעים, מפעילות תכונות זדוניות מסוימות.

למשל, הם גרמו למודל לשקר בכוונה, ואז ניסו לזהות מעין וקטור שמצביע על כיוון כללי – מתי המודל מנסה להערים עלינו ומתי הוא חוזר לתפקיד המקורי שלו כיישות אמינה, כנה ומועילה. נסו לחשוב על זה כברומטר לזיהוי כוונות, או סוג של מכונת אמת למודלים. שיטות כאלה מאפשרות לנו לנטר את הסיכון שהמודל יבחר בהתנהגות לא צפויה או מזיקה.

בתמונה: החוקרים של אנטרופיק ניסו לאמן את המודל הזדוני, לבצע למידה מבוססת חיזוקים ואף לפקח עליו עם Red Team, ואז בדקו אם פעולות אלו הובילו לזיהוי הסוכן הרדום | Credit: Anthropic.

חשוב להדגיש – כל זה נעשה על דגמים שנבנו במיוחד לצורך המחקר, ואין הוכחה שמודלים מסחריים אכן מתנהגים כך באופן ספונטני. ועדיין, עצם היכולת להסתיר מטרות או התנהגויות באמצעות דלתות אחוריות (ולהישאר מתחת לרדאר של כלים מקובלים) מדגישה עד כמה מורכב, מסובך וקשה להפוך מערכות AI לבטוחות. אם נשען רק על בדיקות שטחיות או על הרושם שהמערכת מתנהגת כראוי ברוב הזמן, אנו מסתכנים בהפתעות לא נעימות. מה הפתרון? להמשיך לחקור מצבי קיצון כאלה, לחדד ולדייק את הכלים שמסתכלים פנימה – מתחת למכסה המנוע, וכך לזהות בזמן אמת תהליכים חריגים.

מה שבטוח – אסור לנו להניח שמערכות AI יישארו תמיד נאמנות למטרה שלשמן נבנו, וצריך תמיד לזכור שישנם גורמים זדוניים שישמחו לעשות שימוש לרעה בטכנולוגיה זו, הן לתועלת עסקית, פלילית ואפילו למטרות טרור או בשדה הקרב. מפחיד כבר אמרנו?

בואו ללמוד איתנו בינה מלאכותית בקורס המקיף, העשיר והמבוקש בשוק. הצטרפו לאלפים הרבים שכבר עברו את הקורסים והסדנאות שלנו. פרטים והרשמה באתר.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...