דף הבית » מה באמת עוזר לסוכן שלכם? Agent Skills במבחן האמת

אי אפשר לגלול היום בפיד טכנולוגי בלי להיתקל במישהו שמכריז בהתלהבות על ה‑Skill החדש שכתב. בחודשים האחרונים Skills הפכו לאחד הטרנדים החמים בעולם הסוכנים: חבילות קטנות של הוראות שמלמדות את הסוכן איך לבצע משימה בצורה עקבית. בקהילות כבר מסתובבים עשרות אלפי Skills, חברות משלבות אותן בתהליכי העבודה שלהן, ו‑Anthropic מציגה אותן כחלק מרכזי בארכיטקטורה של סוכני ה‑AI המודרניים. אבל בתוך כל ההתלהבות הזאת, כמעט אף אחד לא עצר לשאול את השאלה הפשוטה באמת: האם Skills באמת משפרים את ביצועי הסוכנים - או שכולנו פשוט מניחים שזה נכון?

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

מחקר חדש ומקיף שפורסם במרץ 2026 בשם SkillsBench מנסה לענות על השאלה הזאת באופן שיטתי. קבוצה של 105 תורמים ממוסדות מובילים, בהם אוניברסיטת סטנפורד, אוקספורד, אמזון וחברת Anthropic עצמה, הרכיבה אוסף של 84 משימות מ-11 תחומים: מהנדסה של תוכנה ועד רפואה, מסייבר ועד פיננסים. כל משימה הורצה שלוש פעמים.

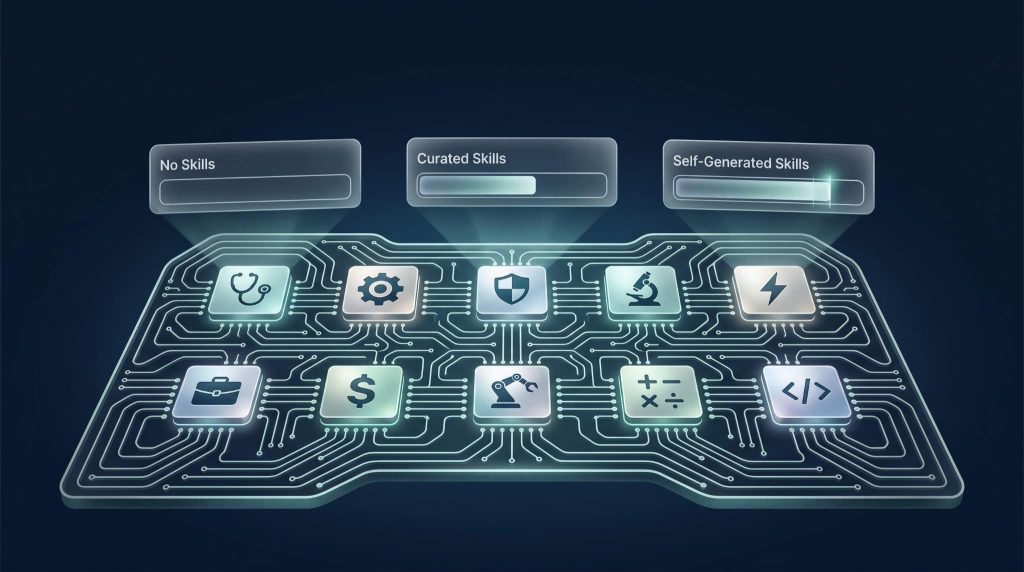

פעם אחת בלי Skills. פעם שנייה עם Skills שבני אדם כתבו. פעם שלישית עם Skills שהסוכן ייצר בעצמו. בסך הכול 7,308 ניסיונות. זה כנראה הניסוי הגדול והשיטתי ביותר שנעשה עד היום על היכולת הזאת. והתוצאות מפתיעות, לפעמים אפילו מטרידות.

הממצא הראשי נראה מצוין על הנייר. Skills מעלים את אחוז ההצלחה בממוצע ב‑16.2 נקודות אחוז. זה שיפור אמיתי ומובהק, אבל מאחורי הממוצע הזה מסתתר סיפור הרבה יותר מורכב.

בתחום הבריאות Skills העלו את אחוז ההצלחה של הסוכנים מ‑34% ל‑86%, קפיצה של כמעט 52 נקודות. בייצור התמונה דרמטית עוד יותר: אחוז הצלחה בודד בלי Skills לעומת 43% איתן. מנגד, בהנדסת תוכנה השיפור היה זעיר, 4.5 נקודות אחוז בלבד, ובמתמטיקה רק 6 נקודות. המסקנה ברורה. בתחומים שבהם המודל כבר מחזיק בידע משמעותי Skills מוסיפות מעט. הן יעילות במיוחד דווקא במקומות שבהם המודל חלש מלכתחילה.

ואז מגיע הממצא שבאמת מטלטל. ב‑16 מתוך 84 המשימות Skills לא רק שלא עזרו אלא ממש הזיקו. במשימת מיזוג טקסונומיה אחוז ההצלחה צנח ב‑39 נקודות. במשימות של ניתוח זרמי חשמל, חקר אסטרונומיה וניתוח סטטיסטי נרשמו ירידות של 11 עד 14 נקודות. נראה ש‑Skills ארוכים ומפורטים מדי יוצרים עומס או סתירה כשהמודל כבר יודע להתמודד עם המשימה בעצמו.

וזה עוד לא הכול. כשהסוכן התבקש לייצר Skills בעצמו, בלי עזרה אנושית, התוצאה הייתה שלילית: ירידה של 1 עד 2 נקודות אחוז בממוצע. זה ממצא משמעותי במיוחד. הסוכן יודע להשתמש היטב ב‑Skill שניתנת לו, אבל הוא לא יודע לכתוב לעצמו אחת איכותית. את הידע התהליכי הזה, כך נראה, רק בני אדם יודעים לספק.

המחקר לא נשאר בתיאוריה. יש בו כמה המלצות מעשיות שאפשר ליישם כבר עכשיו.

ראשית, פחות זה יותר. החוקרים גילו ש‑Skill ממוקד, בערך עמוד או שניים של הוראות, עובד הכי טוב. כשניסו לכתוב Skill מקיף עם כל המידע האפשרי, הביצועים דווקא ירדו ב‑3 נקודות אחוז. מסתבר שהסוכן מתקשה לחלץ את המידע הרלוונטי מתוך הוראות ארוכות מדי.

שנית, שניים או שלושה Skills למשימה הן הכמות האידיאלית. תוספת של Skill רביעית מורידה את השיפור מ‑18 נקודות ל‑6 נקודות בלבד. זה לא מזיק ממש, אבל היתרון כמעט נעלם.

שלישית, ואולי הממצא המעניין ביותר: מודל קטן עם Skills טובים יכול לנצח מודל גדול בלי. Claude Haiku 4.5 עם Skills הגיע ל‑27.7 אחוזי הצלחה, בעוד ש‑Claude Opus 4.5 בלי Skills הגיע רק ל‑22 אחוזים. כלומר, אפשר לחסוך משמעותית בעלויות ההפעלה אם משקיעים בכתיבת Skill איכותית במקום בשדרוג המודל.

רביעית, ההקשר חשוב. אם העבודה שלכם בהנדסת תוכנה או מתמטיקה, אל תצפו ש‑Skill יעשה קסמים. אבל בתחומים מתמחים כמו רפואה, תהליכי ייצור, אנליזה משרדית או סייבר, השקעה ב‑Skill מדויק יכולה להיות האוטומציה הרווחית ביותר שתעשו השנה.

וחמישית, הממצא על Skills שהסוכן מייצר בעצמו פותח הזדמנות מעניינת. המחקר בדק מצב שבו מבקשים מהמודל לכתוב Skill מראש, לפני שביצע את המשימה. אני מוצא שאם הופכים את הסדר, קודם מריצים איתו את המשימה עד הסוף ורק אז מבקשים ממנו לסכם אותה כ‑Skill, התוצאות טובות בהרבה. ההבדל קטן אבל מהותי. במקום לבקש מהמודל לנבא איך תיראה פרוצדורה נכונה, נותנים לו לבצע אותה פעם אחת ואז לזקק אותה מהניסיון עצמו. זו לא תוצאה מהמחקר, אלא שיטה שפיתחתי בעצמי, אבל היא מתיישבת היטב עם מה שכן מופיע בו.

כל זה רלוונטי במיוחד עכשיו, כש-Skills הפך לשפה המשותפת של תעשיית הסוכנים. Claude Code, Gemini CLI ו-Codex של OpenAI כולם תומכים במנגנון, אבל לא באותה איכות. החוקרים גילו ש-Claude Code מנצל Skills בצורה הרבה יותר עקבית, בעוד ש-Codex לעיתים קרובות פשוט מתעלם מה-Skill שסופק לו. הבחירה בכלי, מסתבר, לא פחות חשובה מהבחירה בתוכן ה-Skill עצמו.

אני חושב שהמסר האמיתי של המחקר הוא זה: Skills הם כלי חזק, אבל לא קסם. הם עובדים כשהם ממוקדים, קצרים וממלאים פער ידע אמיתי. הם נכשלים כשהם מיותרים, מפורטים מדי או סותרים את מה שהמודל כבר יודע לבצע בעצמו.

אם הייתי צריך לבחור משפט אחד מכל המחקר, זה היה: "יעילות Skills אינה אוניברסלית, אלא תלויית הקשר." זה אולי נשמע כאזהרה זהירה של אקדמאים, אבל זו למעשה הבשורה הטובה. סוף סוף יש לנו נתונים, לא רק תחושות. סוף סוף אפשר להפסיק להניח ש-Skills תמיד עוזרים, ולהתחיל לבדוק מתי הם באמת עובדים.

לפני שאתם כותבים את ה-Skill הבא שלכם, שאלו את עצמכם שתי שאלות פשוטות. האם המשימה באמת דורשת ידע תהליכי שהמודל לא מכיר? והאם ההוראות שלכם מספיק ממוקדות כדי שהמודל יוכל לעקוב אחריהן? אם התשובה לשתי השאלות היא כן, אתם בדרך לכלי עבודה משמעותי. אם לא, אולי עדיף פשוט לוותר על ה-Skill ולתת למודל לעבוד.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...