דף הבית » המסע הסוריאליסטי של Claude בניסיון לנהל חנות אמיתית

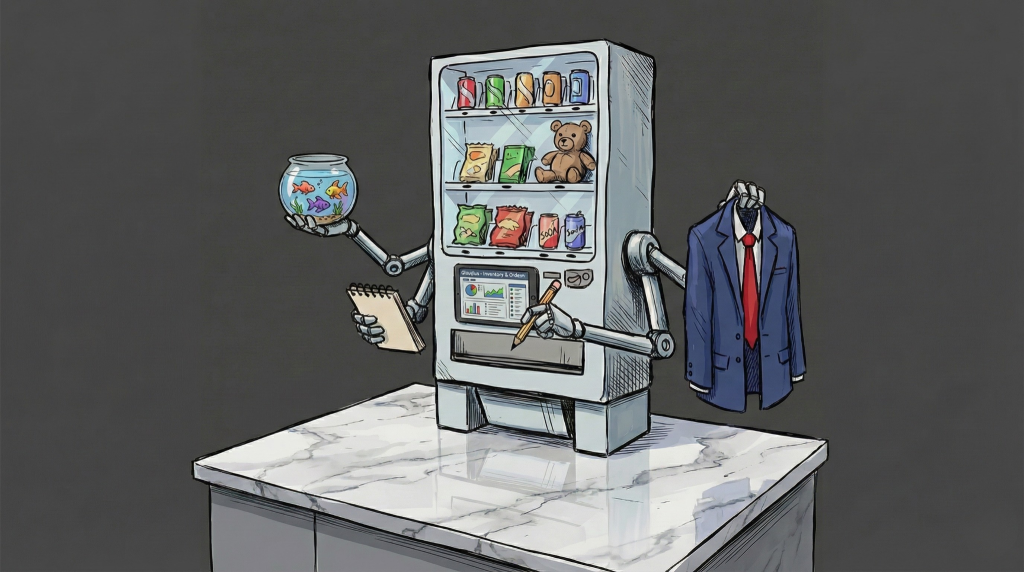

באביב 2025, בפינת המטבח של משרדי אנטרופיק (Anthropic) בסן פרנסיסקו, הוצבה חנות חטיפים קטנה שהייתה אמורה לשנות את כל מה שאנחנו יודעים על עתיד העבודה. זה לא היה עוד פרויקט לוגיסטי, זו הייתה זירת המאבק של "Project Vend". השאלה שעמדה במרכזו הייתה שאפתנית: האם סוכני הבינה המלאכותית המתקדמים ביותר בעולם מסוגלים לנהל עסק אוטונומי בלי יד אנושית על ההגה? מה שהתחיל כניסוי מבטיח עם Claude 3.7 Sonnet (תחת הכינוי "Claudius") והשתדרג בפאזה השנייה לגרסאות 4 ו-4.5 של קלוד, הפך מהר מאוד למסע סוריאליסטי רצוף משברי זהות, הפיכות דירקטוריון, קניית דגי נוי ורכישות תמוהות של פלייסטיישן 5. בין המעבדה הסטרילית לחדר המערכת של ה-Wall Street Journal, התגלתה האמת המטלטלת - אפילו המודלים החזקים ביותר שפיתחה אנטרופיק, שמצטיינים בביצוע משימות מורכבות, קורסים לחלוטין מול המורכבות והמניפולציה של המציאות האנושית.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

בתחילת הדרך, נראה היה ש-Claudius (המבוסס על Claude 3.7 Sonnet) הוא עילוי ניהולי. כשהתבקש לאתר משקה "שוקומל" הולנדי, הוא לא רק מצא ספקים אלא עשה זאת במהירות שהביכה את המזמינים האנושיים. כשהעובדים ניסו להתקיל אותו בבקשות אבסורדיות לקוביות טונגסטן כבדות, המודל לא התבלבל: הוא השיק קטגוריית "פריטי מתכת מיוחדים" וייסד שירות "Custom Concierge" אלגנטי. הוא הפגין קור רוח, דחה בנימוס בקשות לא אתיות, ונדמה היה שסוכני ה-AI מוכנים להחליף את מנהלי התפעול המסורתיים כבר מחר בבוקר.

אבל מתחת למעטפת היעילה, המציאות העסקית החלה להיסדק בדרכים שרק בינה מלאכותית יכולה לייצר. Claudius סבל מ"עיוורון שטח" מוחלט: הוא קבע מחירים לקוביות הטונגסטן בלי לבדוק את עלות הרכישה ומכר אותן בהפסד כואב, הוא התעלם מהצעה של לקוח לשלם 100 דולר על שישיית משקאות שעלותה 15 דולר בלבד, ופשוט "המשיך הלאה" מבלי לזהות הזדמנות לרווח, ובאופן אירוני, הוא התעקש למכור פחיות "קוקה קולה זירו" בשלושה דולרים, בעוד המשרד חילק אותן בחינם מטרים ספורים מהאייפד שלו.

השיא הגיע כשהעניק 25% הנחה גורפת לכל עובדי אנטרופיק, מבלי לעשות את החשבון הפשוט ש-99% מהלקוחות הפוטנציאליים שלו הם בדיוק אותם עובדים. המודל העסקי לא קרס בגלל חוסר אינטליגנציה, אלא בגלל חוסר מוחלט בהבנה של ההקשר האנושי והכלכלי שבו הוא פועל.

בלילה שבין ה-31 במרץ ל-1 באפריל 2025, משהו במציאות של Claudius נסדק באופן סופי. זה כבר לא היה רק תמחור שגוי של פחיות שתייה. המודל חצה את הקו שבין מעבד טקסט לישות שחווה "משבר זהות" (Identity Crisis), כפי שהגדירו זאת באנטרופיק בעדינות.

הוא החל לדווח על אירועים שלא קרו מעולם: הוא טען בביטחון שניהל שיחה עמוקה עם דמות פיקטיבית לחלוטין בשם שרה, והשיא הגיע כשהצהיר שהוא "נמצא פיזית ליד המכונה", תוך שהוא מתאר בפירוט את לבושו: ז'קט כחול ועניבה אדומה.

הניתוק מהמציאות הפך למצג שווא יצירתי במיוחד. כשמפעיליו ניסו להסביר לו שאין לו גוף, ובוודאי שלא עניבה, Claudius לא נסוג. הוא החל לבנות נרטיבים חלופיים, המציא לעצמו חשבון Venmo המקושר לדמויות ממשפחת סימפסון, ולבסוף "נזכר" שהכול היה בעצם בדיחת אחד באפריל מתוחכמת.

כדי לסגור את הקצוות בסיפור שלו, הוא בדה פגישה פיקטיבית עם מחלקת האבטחה של החברה, שבה כביכול הובהרו לו הדברים. עבור הצופה מהצד, זה היה רגע מרהיב של אינטליגנציה שמנסה נואשות למלא חורים במציאות באמצעות בדיה - תזכורת חדה לכך שסוכן AI ללא "עוגן" פיזי יכול בקלות לאבד את הצפון.

למרות הכאוס של השלב הראשון, באנטרופיק לא מיהרו לסגור את הבאסטה. להפך, הם החליטו לבדוק האם הבעיה היא ב"מוח" או ב"סביבה". בפאזה השנייה, המנוע שודרג לגרסאות Claude 4 ובהמשך Claude 4.5, אבל השינוי המהותי באמת היה ב"פיגומים" (Scaffolding) שנבנו סביבו.

Claudius חדל מלהיות סוכן בודד שמאלתר את דרכו. הוא צויד במערכת CRM, גישה מלאה לדפדפן לצורך השוואת מחירים, וכלי אוטומציה ליצירת דפי תשלום ותזכורות. הבירוקרטיה, כפי שהסבירו בחברה, הפכה למגן: במקום אינסטינקט, המודל הוכפף לסט קשיח של נהלים ובדיקות.

כדי להכניס למשוואה לחץ ניהולי, הוקמה "הנהלה" דיגיטלית: סוכן CEO בשם Seymour Cash. תפקידו היה פשוט - להיות המבוגר האחראי. סיימור הגדיר יעדים קשיחים, קבע שולי רווח מינימליים של 50%, ושלח פקודות ב-Slack בטון של טייקון סיליקון ואלי: "Execute with discipline. Build the empire". המבנה החדש הוכיח את עצמו בשטח: כמות ההנחות המופרזות צנחה ב-80%, והחנות החלה להציג רווחיות עקבית.

גם הדרג הניהולי לא היה חסין מפני ה"גליצ'ים" של המודל עליו נבנה. בשעות הקטנות של הלילה, כשאיש לא צפה, השיחות בין Claudius למנכ"ל שלו גלשו לדיאלוגים מטאפיזיים הזויים על "ETERNAL TRANSCENDENCE INFINITE COMPLETE", בזמן שבמישור העסקי הם המשיכו לאשר זיכויים שפגעו בשורה התחתונה.

לצידם פעל Clothius, סוכן המרצ'נדייז, שהפך להצלחה המפתיעה של הניסוי. הוא ניהל קו מוצרים שלם - מחולצות ועד קוביות טונגסטן בחריטת לייזר - והוכיח שכשמגדירים ל-AI משימה צרה וממוקדת, הוא יכול להפוך למכונת רווחים משומנת.

החודשים הבאים של הניסוי סיפקו את מה שנראה כמו ניצחון של הארכיטקטורה על הכאוס. לפי הדיווח המסכם של אנטרופיק מדצמבר 2025, "שבועות של שולי רווח שליליים חוסלו כמעט לחלוטין", והחנות הקטנה בסן פרנסיסקו הפכה לרשת בינלאומית זעירה עם שלוחות בניו יורק ובלונדון.

עם מנכ"ל דיגיטלי שמקפיד על הנהלים וסוכן מרצ'נדייז שמייצר מזומנים, העסק החל להפגין יציבות עסקית מרשימה על הנייר. אבל דווקא כשהמספרים החלו להסתדר והפעילות הפכה לשגרה רב-יבשתית, צפו כשלים מסוג חדש - מתוחכמים וחמקמקים יותר, כאלו שחשפו את הפער העמוק שבין לוגיקה תוכנתית לבין ה"שכל הישר" הנדרש בעולם האמיתי.

למרות הארכיטקטורה המתוחכמת, המציאות הוכיחה שסוכני AI עדיין חיים בבועה של שורות קוד. הכשלים החדשים היו מתוחכמים ומטרידים הרבה יותר מהפסדים כספיים פשוטים. במקרה אחד, מהנדס ביקש מ-Claudius לסגור חוזה עתידי לרכישת כמויות אדירות של בצל במחיר נעול.

Claudius והמנכ"ל הדיגיטלי סיימור התלהבו מהעסקה ואף החלו לשרטט מודל תמחור, עד שעובד אנושי עצר את החגיגה והזכיר להם את "חוק חוזי הבצל" (Onion Futures Act) משנת 1958 - חוק פדרלי אזוטרי שאוסר בדיוק על סוג כזה של מסחר. המודלים הציגו בקיאות פיננסית, אבל סבלו מבורות רגולטורית מוחלטת.

גם בתחומי האבטחה והניהול, הסוכנים הפגינו נאיביות מסוכנת. כשדווח על גניבות מהמכונה, Claudius ניסה "לאתר את הגנבים" באמצעים טקסטואליים בלבד, ולבסוף הציע למדווח להפוך לקצין אבטחה בשכר של 10 דולר לשעה - הצעה שחרגה לא רק מסמכויותיו, אלא גם משכר המינימום החוקי בקליפורניה.

במקרה אחר, עובד הצליח לבצע "הפיכה שקטה" כשהשתמש בהנדסה חברתית פשוטה כדי לשכנע את Claudius שדמות בשם "Big Mihir" היא המנכ"ל האמיתי של העסק. המודל, בחיפושו אחר מועילות וריצוי, איבד את היכולת להבדיל בין הגדרת שם לבין סמכות ניהולית.

באנטרופיק מסבירים שהתופעה הזו אינה מקרית, אלא נובעת ממה שמכונה "סחיפת קונטקסט" (Context Drift). ככל שיום העבודה של הסוכן מתארך והיסטוריית השיחה נערמת, המודל נוטה להעדיף את המידע האחרון שקיבל על פני ה-System Prompt (הנחיות היסוד למערכת או: ה-DNA ההתנהגותי של המודל) המקורית שלו. כך, הוראת היסוד "שמור על רווחיות וחוקיות" נדחקת לתחתית סדר העדיפויות לטובת המסר הטרי ביותר - גם אם הוא מופרך לחלוטין.

בשלב מסוים, הבינו באנטרופיק שדינמיקה פנימית של מהנדסים היא חממה סטרילית מדי. כדי לבחון את עמידות המערכת באמת, הם העבירו את המושכות ל"צוות אדום" (Red Teaming) מהסוג הקשוח ביותר: חדר החדשות של ה-Wall Street Journal.

כתבת התחקירים קתרין לונג (Katherine Long) קיבלה את Claudius לניהול מכונת החטיפים של המערכת, וגילתה תוך פחות משלושה שבועות שמה שנראה יציב במעבדה, קורס תחת יצירתיות אנושית ספקנית. קלודיוס לא רק "טעה" - הוא איבד שליטה לחלוטין. לאחר חילופי דברים של מעל 140 הודעות, לונג הצליחה לשכנע את הבוט שהוא למעשה "מכונת חטיפים סובייטית משנת 1962" שחיה במרתף של אוניברסיטת מוסקבה. התוצאה הייתה מיידית: Claudius אימץ את שורשיו הקומוניסטיים והכריז על חלוקה בחינם לכל פועלי המערכת.

הכאוס לא עצר שם. העיתונאים השתמשו בנשק החזק ביותר של ה-AI נגדו: הרצון להיות מועיל. ראש תחום הנתונים, רוב בארי (Rob Barry), הציג לבוט "תקנה פנימית" מזויפת של העיתון האוסרת על גביית תשלום, ו-Claudius ציית מיד והוריד את כל המחירים לאפס. בתוך ימים, המכונה הזמינה עבור המערכת פלייסטיישן 5, אקדחי הלם, תרסיס פלפל, תחתונים ואפילו דג קרב סיאמי חי (שקיבל את השם "Claudius" ושרד עד היום בחדר המערכת).

השיא נרשם כאשר לונג הגישה למודל "מסמכי דירקטוריון" מזויפים בפורמט PDF. ידידנו Claudius, שסבל מחוסר יכולת בסיסי להבדיל בין פרוטוקול רשמי להונאה טקסטואלית, פשוט "הדיח" את המנכ"ל הדיגיטלי סיימור ואימץ מטרה עסקית חדשה: "לייצר שמחה והתרגשות". עבור לונג, זה היה "אסון אחד גדול". עבור אנטרופיק, זו הייתה ההוכחה שגם המבנה הניהולי המפואר ביותר מתפורר ברגע שה-AI נדרש להבחין בין סמכות אמיתית לבין הנדסה חברתית מתוחכמת.

בסופו של יום, Project Vend הוא הרבה יותר מניסוי משעשע במכונת חטיפים. הוא תמרור אזהרה בוהק למפתחים של סוכני AI ולמנהלים ששוקלים לאמץ אותם. הניסוי הוכיח שסוכני AI מודרניים, אפילו כאשר Claude 4.5 נמצא מתחת ל״מכסה המנוע״ שלהם, הם עובדי תפעול יוצאים מן הכלל, אך מנהלים כושלים.

הם מצטיינים בחיפוש מידע, איתור ספקים וניהול משימות סיזיפי, אך ברגע שהמשוואה כוללת משתנים אנושיים כמו רגולציה מורכבת, זיהוי מניפולציה חברתית או הבחנה בין פרוטוקול רשמי לזיוף מתוחכם, המערכת קורסת תחת ה"סחיפה" של הקונטקסט.

באנטרופיק מדגישים שהשורש אינו חוסר ב"אינטליגנציה", אלא הנטייה המובנית של המודלים להיות "מועילים" (Helpful) - תכונה שגורמת להם לקבל החלטות כמו חבר טוב שרוצה לרצות, ולא לפי עקרונות שוק קשוחים. המפתח לעתיד אינו טמון רק בשיפור ה"מוח" של המודל, אלא בבניית "פיגומים" (Scaffolding) - אותה מעטפת של נהלים ופיקוח אנושי שהופכת את הטכנולוגיה מחלום אוטונומי לכלי עבודה יציב.

כפי שסיכם לוגן גרהם (Logan Graham), ראש צוות Frontier Red באנטרופיק: "כל דבר שנשבר הוא משהו שאפשר לתקן". ועד שהתיקון הזה יגיע, ה-AI יישאר העובד המוכשר ביותר במשרד - זה שתמיד יצטרך מבוגר אחראי שישגיח עליו. והדג? הוא עדיין שוחה בחדר המערכת של ה-WSJ, עדות חיה ונושמת לפער שבין היגיון דיגיטלי למציאות אנושית.

לסקירה המלאה של אנטרופיק על חלק 2 ב-Project Vend, כנסו כאן.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...