דף הבית » האם ה-AI Slop יהרוס לנו את האינטרנט?

גם אתם מרגישים לאחרונה שאתם טובעים בתוכן שנראה מבריק מבחוץ אבל מרוקן מבפנים? שגלילה אחת ברשת חושפת אינספור סרטונים, מאמרים ותמונות שנוצרו על ידי מכונה ולא על ידי אדם? שפתאום קשה לדעת מה אמיתי ומה נוצר רק כדי לגנוב לכם כמה שניות של תשומת לב? נדמה שכל פוסט, קליק או סרטון הם חלק ממבול אינסופי של טקסטים ותמונות חסרי נשמה. לתופעה הזו קוראים AI Slop והיא יכולה לשנות מקצה לקצה את האינטרנט - ובכלל לא בטוח שלטובה!

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

המונח “AI Slop” מתאר את התוכן הנמוך, הממוחזר והמג'ונרט, שמציף את הרשת: מאמרים חסרי נשמה, סרטונים חסרי ערך, מוזיקה שנשמעת מוכרת מדי, ספרים מג'ונרטים שנכתבים על-ידי בוטים בהמוניהם, ואפילו חדשות שנכתבות ללא עיתונאי אמיתי מאחוריהן. זוהי למעשה שכבה עצומה של מידע סינתטי שנוצרת באמצעות כלים של בינה מלאכותית גנרטיבית (Generative AI) – אותם מנגנונים שיודעים "להמציא" טקסט, תמונה, צליל או וידאו חדשים על בסיס דוגמאות קיימות. חשוב לציין - אנחנו לא מדברים על תכנים שנוצרו בסיוע של AI בתהליך היצירה שלהם, אלא על תכנים שנוצרים בצורה אוטומאטית לגמרי, לרוב כמעט ללא מעורבות יד אדם. תכנים שמועברים באמצעות אוטומציות ליוטיוב, ספוטיפיי, לינקדאין ועוד.

מסתבר שהבינה היוצרת (Gen AI), יוצרת קצת יותר מדי! מחקרים חדשים מראים שבאזורים מסוימים של האינטרנט, אחוז התוכן שנוצר על ידי מכונות כבר חוצה את הסף המדאיג: מחקר שפורסם ב-2025 מצא כי כ-40% מהפוסטים החדשים ב-Quora וב-Medium הם ככל הנראה תוצר של AI. מדובר בקפיצה של עשרות אחוזים בתוך שנתיים בלבד – והכיוון ברור.

אם נדמה היה שהרשת עמוסה בפרסומות ובספאם עוד לפני עידן ה-AI, הרי שכיום רוב מה שאנחנו רואים, קוראים ומקשיבים לו כבר לא נכתב על ידי בני אדם. לפי דו"ח Imperva לשנת 2025, כמחצית מהטראפיק ברשת כולה מופק על-ידי בוטים, וחלק גדול מהם משמשים למטרות הרסניות כמו גניבת מידע, מניפולציות על חשבונות ויצירת תעבורה מזויפת.

התוצאה: מציאות שבה קשה לדעת מי עומד מאחורי כל קליק או תגובה – אדם אמיתי, או מכונה שתוכנתה לחקות אחד כזה? התמונה הזו מקבלת מימד נוסף כשנזכרים שהבוטים עצמם משתמשים באלגוריתמים מבוססי AI כדי להיראות "אנושיים" יותר.

יצירת תוכן הייתה בעבר ביטוי ליצירתיות אנושית – כתיבה, ציור, מוזיקה או צילום דרשו השקעה, מחשבה וידע. היום, כל אחד יכול לייצר "ספר" בלחיצת כפתור. מחקר של Originality.AI משנת 2024 מצא שיותר ממחצית מהפוסטים הארוכים ב-LinkedIn כבר נוצרו על ידי AI. וזה היה שנה שעברה - המצב היום חמור הרבה יותר!

באמזון, תופעת הספרים המזויפים (כאלה שנכתבו על ידי AI ומתחזים לכותבים אמיתיים) הפכה לאיום ממשי על סופרים בשר ודם. החברה נאלצה להגביל את מספר הספרים שניתן לפרסם ביום לשלושה בלבד. אפילו העיתונות המקוונת סובלת: אתרי חדשות שמופעלים כמעט לגמרי על ידי תוכנות כתיבה אוטומטיות כבר הפכו למציאות קיימת. לפי דו"ח של NewsGuard משנת 2025, קיימים כיום מעל 1,200 אתרי חדשות מזויפים שמופעלים בידי AI, ומפיצים מידע שקרי בשפות רבות ברחבי העולם. וכשרשתות תעמולה שכאלה מופעלים על ידי משטרים מפוקפקים (כן פוטין... אני מסתכל עליך), התוצאה יכולה להיות הרסנית - הנדסת תודעה בקנה מידה נרחב! אם זה מעניין אתכם, כתבנו מאמר שלם בנושא רשתות דיסאינפורמציה פרו-קרמליניות, מבוססות AI. כשמשלבים את זה עם LLM Grooming, אותם תכני AI מוצאים את דרכם למאגרי האימון של מודלי השפה, שממשיכים להדהד את המסרים השקריים.

למה התכנים הללו כל כך משכנעים? חלק מהבעיה טמון באשליה. תוכן שנוצר על ידי בינה מלאכותית נראה חכם, מדויק ומשכנע. למה? בעיקר כי הוא מאוד "בטוח בעצמו". הוא כותב בשפה סמכותית, משלב עובדות אמיתיות עם עובדות אחרות שהוא בדה ממוחו הקודח, וכל זה משאיר רושם של אמינות.

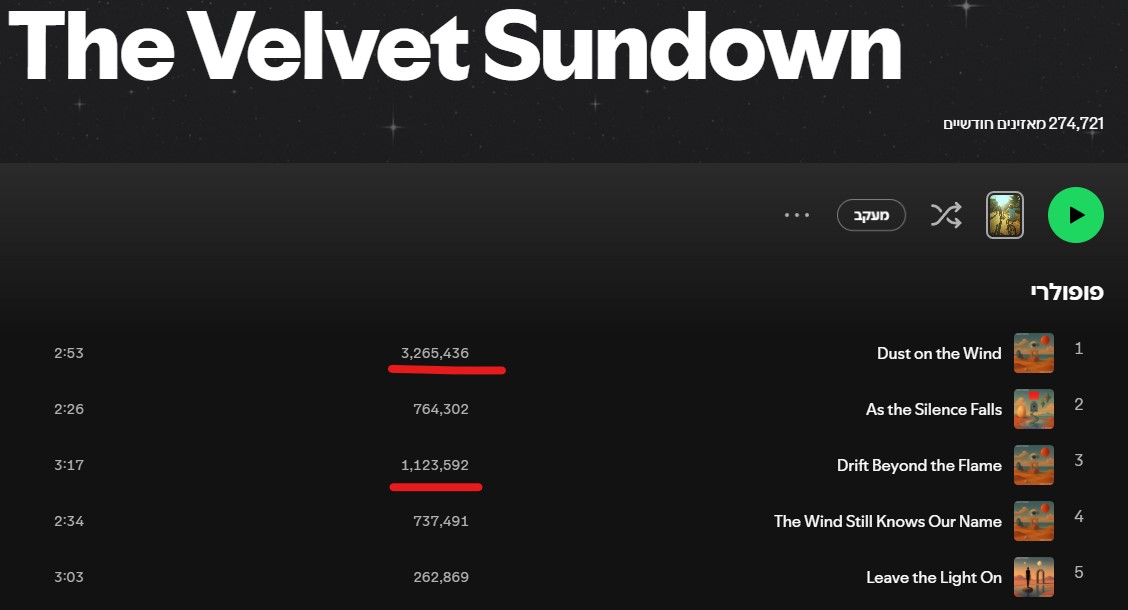

הבעיה אינה מוגבלת לטקסט בלבד. גם עולם המוזיקה עובר שינוי דרמטי. להקות שמעולם לא היו קיימות מצליחות להגיע למיליוני האזנות, ורק לאחר מכן מתגלה שהן נוצרו לחלוטין באמצעות בינה מלאכותית – מהמילים ועד לתמונת היח"צ. עם כלים כמו Suno ו-Udio כל כך קל לייצר היום מוזיקה מג'ונרטת. וכן - זה נשמע טוב! דוגמה בולטת היא הלהקה Velvet Sundown, שכבשה את Spotify עם למעלה ממיליון האזנות לפני שהתברר שמדובר בפרויקט מלאכותי.

מיליוני צפיות: the Velvet Sundown בספוטיפיי.

טכנולוגיות GenAI מאפשרות היום אפילו להחזיר אמנים מן המתים - כך עפרה חזה וזוהר ארגוב חזרו לדואט מרגש ביום העצמאות 2023, שנים לאחר מותם.

אמנם במקרה הזה לא מדובר ב-AI Slop, אלא בתוכן שהופק בקפידה, ונעשה בשיתוף עם משפחותיהם של זמרי-העל הישראליים, אבל הוא ממחיש את הקלות הבלתי נסבלת שבה תוכן סינטטי "עובר" כאמיתי. כל הסיפור הזה מציף שאלות פילוסופיות - האם זה מוסרי? האם מותר להשתמש בקולו של אדם לאחר מותו? וגם אם הכל 100% AI - מה זה בעצם אומר ש"התאהבתי" בשיר AI? האם תוצרי AI יכולים להתחרות בתוצרים של אמנים אנושיים? או שאולי אנחנו צריכים לשאול שאלה הפוכה - האם ליוצרים אנושיים יהיה את הכוח, המשאבים ואורך הרוח להתחרות בתוצרי AI שרק ילכו ויהפכו ליותר ויותר איכותיים, קליטים ומהפנטים?

הבעיה חמורה עוד יותר כשמוזיקה כזו משמשת להונאות תמלוגים. אמנים מזויפים מעלים אלפי שירים לאותן פלטפורמות, ומפעילים בוטים שמנגנים אותם שוב ושוב. מדובר בתעשייה של מאות מיליוני דולרים שמחסלת בפועל את ההכנסות של מוזיקאים אמיתיים ומייצרת בעיות אמיתיות לשירותי הסטרימינג.

עד לא מזמן, האינטרנט פעל על עיקרון פשוט: אתרים מייצרים תוכן, גולשים מוצאים אותו דרך גוגל, וגוגל מחלקת את התנועה בהתאם לרלוונטיות. אך מאז השקת מנגנון "AI Overview" של גוגל, המערכת מסכמת בעצמה את המידע ומציגה את התשובה ישירות בדף החיפוש. לכאורה מדובר בנוחות מרבית, אך בפועל, אתרי תוכן מאבדים תנועה והכנסות. לפי מחקר של Bain & Company, כ-80% מהמשתמשים צורכים כעת תוצאות "אפס קליקים" (Zero Clicks) – כלומר, הם מקבלים תשובה מה-AI ואינם מבקרים עוד באתרי המקור. המשמעות הכלכלית ברורה: פחות חשיפה, פחות פרסום, ופחות תוכן איכותי שנוצר בידי אנשים. להרחבה, קראו את המאמר שכתבתנו בנושא זה.

בתמונה: דו"ח של Similarweb שמראה את הירידה בהפניות האורגניות בגוגל (גולש שהקליק על כתבה והועבר לאתר חיצוני), אל מול העלייה בזירו קליקס (גולש ששאל שאלה בגוגל, וקיבל מיד תקציר AI, מבלי להמשיך לאתר חיצוני).

כדי לייצר תוכן חדש, מערכות AI צריכות קודם "ללמוד" מתוכן קיים – וזהו לב הבעיה. החברות שמאחורי המודלים משתמשות באינספור טקסטים, תמונות וקטעי וידאו שפורסמו על ידי יוצרים אמיתיים, לרוב בלי ידיעתם או רשותם. ב-2025 נחשף כי Reddit מכרה את מאגר התגובות שלה לגוגל ול-OpenAI תמורת עשרות מיליוני דולרים בשנה. גם YouTube אושר כמאגר אימון עבור מודל הווידאו של גוגל, Veo3. במקביל, אמנים ב-DeviantArt גילו כי עבודותיהם שימשו כבסיס ליצירת תמונות סינתטיות שנמכרות חזרה בפלטפורמה.

היצירה האנושית הפכה לחומר גלם בחינם. ההכנסות זורמות לחברות, ולא לאמנים. לפי CISAC (הקונפדרציה הבינלאומית של אגודות היוצרים והמלחינים), יוצרי מוזיקה וקולנוע צפויים לאבד עד 22 מיליארד אירו בהכנסות עד 2028 כתוצאה מהשפעת הבינה היוצרת.

כמות התוכן הסינתטי באינטרנט לא רק מזהמת את המרחב הציבורי, אלא גם מאיימת על עצם היכולת של המודלים להמשיך ללמוד. ככל שמערכות בינה מלאכותית ניזונות מתוכן שנוצר על ידי AI, כך האיכות שלהן מתדרדרת – תופעה שמכונה "אוטופגיה של בינה מלאכותית" (AI Autophagy). מחקר שפורסם בכתב העת Nature מזהיר כי שימוש הולך וגובר בתוכן סינתטי כנתוני אימון יוביל ל"התמוטטות מודלים": מצב שבו האלגוריתמים מאבדים את היכולת להבין מהו מידע אמיתי ומהו ג'ינרוט חסר ערך. כאשר מודלים מאמנים זה את זה על בסיס נתונים מלאכותיים, הם נוטים להיכשל בהבנת המשימה המקורית, ובכך למעשה "להשחית" את עצמם.

אילוסטרציה: בוט שמאומן על תוכן שבוט אחר יצר.

ההשפעה אינה נעצרת בגבולות המדיה או המסחר. גם המדע, אחד התחומים שהאמינות היא יסוד קיומו, מתחיל להיפגע. לפי מחקר שפורסם ב-Science Advances, לפחות 13.5% מהמאמרים הביו-רפואיים שפורסמו ב-2024 נכתבו או נערכו בעזרת AI, כאשר בתחומים מסוימים הנתון הגיע ל-40%. במאמר אחר שפורסם ב-Nature עלתה תופעה מדאיגה אף יותר - חוקרים שנתפסו "עם המכנסיים למטה" כשהם מסתירים פקודות סמויות (Prompt injection) בתוך מאמרים שכתבו, כדי לגרום למערכות ביקורת מבוססות AI להעניק להם ביקורת חיובית. התוצאה היא מערך מדעי שנשען יותר ויותר על כלים אוטומטיים שאפשר לשבש, להונות ולהשחית בקלות.

התמונה המצטיירת עגומה: עולם שבו אין עוד ודאות מי כתב, מי צילם, מי שר, ומי בכלל אמיתי. תוכן סינתטי מזין את עצמו, והאינטרנט עלול להפוך לסביבה סגורה של שקרים, בלבול וערפול. אך המסקנה אינה בהכרח קטסטרופלית. כמו בכל טכנולוגיה, גם כאן נדרשת אחריות אנושית. מערכות בינה מלאכותית יכולות להפוך לכלי עבודה מופלאים, אך רק אם נשכיל להשתמש בהן בזהירות, תוך שמירה על פיקוח, ייחוס ועריכה אנושית אמיתית. הבעיה אינה נעוצה במכונות, אלא באנשים שבוחרים להפעיל אותן בלי לעצור ולבדוק אם זה אחראי ומועיל (ובמועיל הכוונה - מועיל גם לשאר הציביליזציה האנושית, ולא רק לחשבון הבנק הפרטי שלהם). המודלים הגנרטיביים לא מבינים מהי אמת או מהו ערך, אך אנחנו כן. ואם נמשיך להאכיל את האינטרנט בתוכן ריק, הוא יחזיר לנו בדיוק את מה שנתנו לו – גרסה סינתטית ומעוותת של עצמנו.

האינטרנט התחיל כרשת אנושית של שיתוף ידע, יצירתיות וחיבורים אמיתיים. כדי לשמור עליו כזה, אנחנו נדרשים למאמץ מודע - עלינו להעדיף מקורות אמינים על פני סיכומי AI אוטומטיים. עלינו ליצור במקום לשכפל. ולרגע אל תבינו אותי לא נכון - אין שום בעיה להשתמש ב-AI. אבל אנחנו מאמינים שכל תוצר שנפלט ממערכת AI הוא רק חומר גלם, ולא מוצר סופי. בסופו של יום כדאי שיהיה בן אנוש בתחילת התהליך וגם בסופו. שמישהו עם מוח ודופק יהיה חתום עליו.

בואו ללמוד איתנו בינה מלאכותית בקורס המקיף, העשיר והמבוקש בשוק. הצטרפו לאלפים הרבים שכבר עברו את הקורסים והסדנאות שלנו. פרטים והרשמה באתר.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...