דף הבית » הכירו את סטייבל וידאו

חברת stability.ai, שעומדת מאחורי הכלי המהפכני סטייבל דיפיוז'ן (Stable Diffusion) שיחררה ב-21.11.23 את Stable Video Diffusion ומכוונת היישר לפלח השוק של Pika, Runway ו-Gen2.

בינתיים, אם בא לכן להתנסות בכלי, תוכלו לעשות זאת באמצעות decoherence.

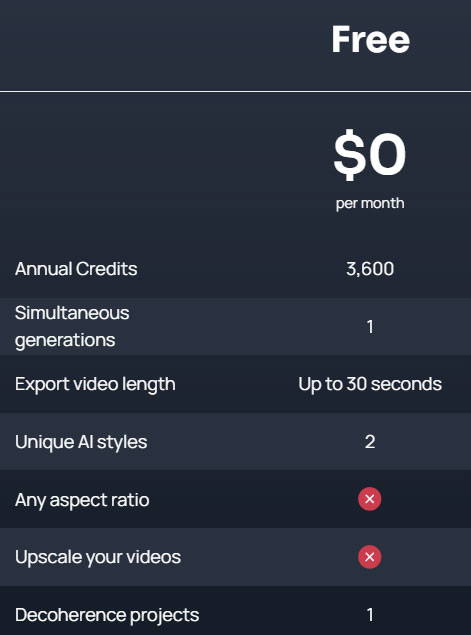

וכן, אם תהיתם - יש להם גם חבילה חינמית:

מוזמנים לצפות בסרטון מטה ולהתרשם מיכולות המודלים החדשים.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...