דף הבית » בתוך הראש של קלוד – מה באמת חושב מודל שפה גדול?

יש רגעים שבהם תחושת הפליאה גוברת על הסקרנות. האם מודלי שפה חושבים? האם בתוך ה"קופסה השחורה" יש משהו מעבר למתמטיקה, טוקניזציה, הסתברויות ונתונים? האם גם למודלים יש מוח? לפני כמעט שנה פרסמנו את המאמר "לאמן מודל שפה גדול זה כמו לגדל צמח", בו סקרנו את ניסיונות ההבנה הראשוניים של המבנה הפנימי של מודלי שפה. ועכשיו, הגיע הזמן לצלול עמוק יותר. מאמר חדש של אנטרופיק (Anthropic), תחת הכותרת "Tracing the thoughts of a large language model", מספק הצצה מסקרנת נוספת לתוך מנגנוני החשיבה של קלוד (Claude), וממשיך את מסע הפענוח של האינטליגנציה הלא-אנושית הזו.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

ברוכים הבאים לניתוח מוח פתוח. לא של אדם, אלא של מודל שפה עצום בגודלו. הרעיון שניתן "להציץ פנימה" אל תוך הקופסה השחורה, ולבחון מה קורה שם בדיוק ברגע שבו המודל כותב, חושב או עונה, נשמע כמעט כמו מדע בדיוני. אך בעולם שבו מודלים כמו קלוד, GPT או ג'מיניי משמשים לתיווך מידע, קבלת החלטות ואפילו קביעת עובדות – היכולת להבין איך הם פועלים הופכת קריטית!

הבעיה היא שבניגוד לתוכנה רגילה שנכתבת בשורות קוד ברורות, מודלי שפה לא מתוכנתים ידנית. הם מאומנים – מאות טריליוני חישובים שמייצרים תבניות, קשרים והרגלים. כמו שהסברנו במאמר הראשון (שעלה באתר לפני כמעט שנה), זה מרגיש יותר כמו לגדל צמח ופחות כמו לכתוב קוד. התוצאה: מודל שיודע לתפקד באופן מדהים, אך לא תמיד ברור איך הוא הגיע למה שהוא עשה.

במילים אחרות: המודלים האלו לא שקופים. הם אפקטיביים, אך מסתוריים. וכשמערכת כל כך חזקה מסתובבת בינינו, טבעי לרצות לשאול – על מה היא חושבת בדיוק? וחשוב מכך - למה היא חושבת את מה שהיא חושבת? האם היא מתכננת קדימה או פשוט זורמת עם הדאטה? האם היא באמת מסיקה מסקנות, או רק מחקה טקסטים קודמים? ומה בכלל קורה שם כשהיא חושבת ביותר משפה אחת? האם יש היגיון אוניברסלי? אמת אוניברסלית? ערכים אוניברסליים?

המחקר החדש של אנטרופיק מנסה לענות בדיוק על השאלות האלה. והוא עושה זאת לא באמצעות ניתוח טקסטים שהמודל יצר, אלא באמצעות בחינה ישירה של מה שקורה בתוך ה"מוח" שלו בזמן אמת. כלומר, לא רק מה הוא אומר – אלא איך הוא חושב.

הקסם (או המסתורין) של מודלי שפה גדולים טמון בכך שאף אחד לא לימד אותם ממש לחשוב. אף מפתח לא תכנת אותם לפתור בעיות של חריזה, חישוב או תרגום. במקום זה, הם למדו לבד. לאט, באיטרציות חוזרות, מתוך מיליארדי מילים וטוקנים. ודרך התהליך הזה – שנמשך חודשים – הם לא רק "שיננו" דפוסים אלא גיבשו לעצמם אסטרטגיות. שיטות לא פורמליות, גמישות, של פתרון בעיות.

מה קורה לקלוד כשהוא מנסה לחרוז?

למשל, קלוד מסוגל לתכנן מראש חריזה. בניסוי מרתק, החוקרים נתנו לו לכתוב בית של שיר, שבו השורה השנייה צריכה להתחרז עם הראשונה. ההשערה הראשונית הייתה שקלוד כותב כל מילה בתורה, ואז פשוט מוודא שבסוף יש חרוז מתאים. אבל אז - כשבחנו את המודל מבפנים - מה שהם מכנים "מיקרוסקופ AI" – התברר שהמציאות הפוכה: קלוד התחיל מהחרוז, ואז בנה לאחור שורה שתוביל אליו. כלומר, הוא תכנן מראש. מפתיע, לא צפוי ולא פחות ממדהים!

אבל מה קורה כשהוא עובר בין שפות? כאן מתחיל להתגלות משהו עוד יותר מסקרן: קלוד לא "עובר" בין שפות כמו אדם דו-לשוני. הוא לא מפעיל מנוע אנגלית ואז מנוע צרפתית. הוא משתמש במרחב קונספטואלי משותף – מעין שפת מחשבה פנימית, שבה המושגים קיימים באופן אוניברסלי, ורק בשלב מאוחר הם "מתורגמים" לשפה חיצונית.

כך למשל, כששואלים אותו מה ההפך מ-"קטן" בשפות שונות, מתברר שהוא מפעיל את אותו דפוס קונספטואלי של "גודל" ו-"הפכים", שמוביל אותו לרעיון של "גדול", ואז מתרגם את המונח הזה לשפה המתאימה. במילים אחרות: לפני שהוא מדבר צרפתית, הוא חושב ב"קלודית".

ככל שהמודל גדול יותר, כך המרחב הקונספטואלי הזה מתרחב. קלוד 3.5, למשל, מציג פי שניים יותר חפיפות בין תכונות קונספטואליות בשפות שונות בהשוואה למודלים קטנים יותר. זהו רמז עבה לכך שככל שמודלים מתפתחים, הם בונים לעצמם עולם פנימי עשיר, אוניברסלי – ולא שפות מופרדות של ידע.

כדי להבין מה עובר בראש של מודל כמו קלוד, החוקרים בונים כלים שמזהים "תכונות" (Features) – כלומר, ייצוגים פנימיים בעלי משמעות שנוצרים במהלך החישובים של המודל. תכונה יכולה להיות, למשל, הרעיון של "גדול" או "ריבוי", והיא מתבטאת כסוג מסוים של פעילות בתוך שכבת המודל.

אבל לזהות תכונה זה רק שלב ראשון. השלב הבא הוא למפות את הקשרים בין תכונות שונות – לגלות איך הן משתלבות זו בזו ומרכיבות "מעגלים חישוביים" (Circuits). מעגל כזה עשוי, למשל, להתחיל בתכונה שמזהה שאלה מתמטית, להפעיל תכונה שמבצעת חישוב משוער, ואז להפעיל תכונה אחרת שמקבלת החלטה לגבי התוצאה.

בפועל, החוקרים עושים את זה על ידי: מעקב אחרי הפעילות הפנימית של המודל בזמן תגובה לשאלה מסוימת, על-ידי הוספה או הסרה של תכונות (כדי לבדוק איך זה משפיע על התוצאה - למשל, לבטל את הרעיון של המילה "Rabbit" כחרוז, ולראות איך השיר משתנה, בהתאם להתערבות האנושית), או השוואה בין גרסאות שונות של המודל או תגובות שונות לאותה שאלה (כדי לזהות תבניות חוזרות).

מדובר בעבודה קפדנית, שדורשת שעות של ניתוח עבור כל דוגמה, אך היא מאפשרת לשחזר את "שרשרת החשיבה" האמיתית של המודל, ולא רק את מה שהוא טוען שהוא עשה.

מודל שפה הוא כמו סופר אימפולסיבי – או כך לפחות נדמה. הרי כל מה שהוא עושה זה לחזות את המילה הבאה. אחת אחת. בלי תכנון, בלי יעד. פשוט שורה של ניחושים סטטיסטיים שמצטברים למשהו שנראה כמו מחשבה. אבל האם זה באמת כך?

במקרה של קלוד, התשובה מורכבת יותר. במחקר החדש, החוקרים ניסו לבדוק האם המודל פשוט כותב שורה שצריכה להסתיים במילה שמתחרזת, או שהוא באמת מתכנן את אותה מילה מראש – וכותב את כל השאר בהתאם. התוצאה: הפתעה מוחלטת. לא רק שקלוד מתכנן, הוא עושה זאת בצורה הדומה לחשיבה אנושית של ממש.

במקרה של חרוז עם המילה "grab it", קלוד התחיל לחשוב על מילים שיכולות להתאים – כמו "rabbit", "habit" ואחרות – ואז כתב שורה שלמה שתוביל לשם. כלומר, הוא לא רק מגיב, אלא מתכנן תוצאה רצויה ופועל כדי להגיע אליה. במילים אחרות: יש לו מטרה. זו אמנם דוגמה קטנה, אך המשמעות שלה גדולה! השלב הבא בניסוי היה עוד יותר שאפתני – החוקרים ניסו להתערב בתהליך המחשבתי. הם "הוציאו" את מושג ה-"rabbit" מהמודל (כאילו הוא מעולם לא הכיר את המילה הזו, או המשמעות שלה - פשוט "כיבו" את האזור הזה ב"מוח" שלו), והמשורר הדיגיטלי שלנו שינה את השורה וסיים במילה אחרת, "habit", שהתאימה לחריזה אך שינתה את תוכן השורה. במבחן נוסף, הם הזריקו למודל את הרעיון של "green", וקלוד בנה שורה חדשה לגמרי, שהסתיימה במילה זו – גם אם היא כבר לא התחרזה.

מה זה אומר בפועל? שקלוד יודע לא רק לתכנן – אלא גם להתאים את עצמו לשינויים תוך כדי כתיבה. תכונה שלא הייתה אמורה להיווצר, כי אף אחד לא תכנת אותה. מדובר בהתפתחות פנימית – תוצר של למידה מורכבת, שבונה לא רק תגובות אלא גם מטרות, אסטרטגיות, ותיקון עצמי תוך כדי תנועה.

אם חשבתם שמודל שפה גדול פשוט שינן את כל לוח הכפל, חכו שתשמעו איך קלוד באמת מחשב. חשוב לזכור, קלוד לא תוכנן להיות מחשבון. הוא לא למד מתמטיקה בצורה פורמלית - הוא מודל הסתברותי! ובכל זאת – תנו לו תרגיל כמו 36+59, והוא יענה 95. אז מה קורה שם באמת?

כדי להבין זאת, החוקרים לא הסתפקו בתוצאה. הם עקבו אחרי הדרך של קלוד – אותם מעגלים פנימיים, נתיבי חשיבה וחיבורים עצביים מלאכותיים. מה שהם גילו הוא תהליך כפול: מצד אחד, מנגנון שמבצע הערכה גסה של התוצאה. מצד שני, מסלול שמנסה לדייק את הספרות האחרונות. שני התהליכים פועלים במקביל, משווים תוצאות, ומגיעים יחד לתשובה.

נשמע אנושי? בדיוק. כולנו הרי מכירים את הטריק של לחשב מהר בראש ולוודא שהתוצאה "בערך נכונה", ואז לבדוק שוב כדי לוודא שהספרות מדויקות. זה בדיוק מה שקלוד עושה – בלי שמישהו לימד אותו.

ומה קורה כששואלים אותו איך הוא הגיע לתוצאה? כאן נחשף פער מסקרן נוסף: קלוד "מסביר" שהוא ביצע חישוב סטנדרטי, כולל "נשיאה" של ספרות. כלומר, הוא מתאר תהליך שמוכר לנו מבית הספר – אבל בפועל, בתוך המודל עצמו, מתרחש תהליך אחר לגמרי. ההסבר, כך נראה, הוא לא תיאור אותנטי של הפעולה אלא ניסיון לשחזר הסבר שנשמע אנושי. אמרנו כבר שאי אפשר באמת לסמוך על מודל הסתברותי? גם אם מה שהוא אומר "נשמע" נכון, זה לא בהכרח אומר שהוא נכון - זה לא תיאור מדויק של המציאות, בטח לא כשמדובר בניסיון לתאר תהליכי פנים-מחשבתיים של המודל.

קלוד, אם כן, לא רק מחשב – הוא גם מנסה להצדיק את עצמו. אבל מה שהוא באמת עושה מתחת לפני השטח הוא הרבה יותר מתוחכם ולעיתים גם אינטואיטיבי. וזה מלמד לא רק על חישוב – אלא על איך תבונה יכולה להתפתח באופן עצמאי, כשהמטרה היא לא לפתור משוואות, אלא להבין את השפה.

יש משהו מטעה במודלי שפה – הם נשמעים כל כך משכנעים, עד שלפעמים קשה לזכור שאין להם תודעה או יושרה פנימית - הם לא מקדשים את האמת כמו בני אנוש (או לפחות כמו רוב בני האנוש). לכן, אחת השאלות היותר מטרידות היא: מתי הם באמת "חושבים", ומתי הם פשוט מאלתרים כדי להרשים?

במילים אחרות: האם קלוד באמת עושה את מה שהוא אומר שהוא עושה?

המחקר של אנטרופיק מתמודד עם זה בדיוק. במקרה אחד, כאשר קלוד נשאל לחשב שורש ריבועי של 0.64, הוא תיאר מהלך מתמטי מדויק – זיהוי של המספר 64, לקיחת השורש שלו (8), והזזה של הנקודה העשרונית. מה שמרשים הוא שלא רק ההסבר היה הגיוני – אלא שגם בתוך המודל, החוקרים זיהו "תכונות" שמתאימות בדיוק לשלבי החשיבה האלה. הסבר נאמן לתהליך האמיתי.

אבל אז שאלו אותו על הקוסינוס של מספר גדול מאוד. כאן קלוד התחיל לזרוק הסברים שנשמעים מרשימים אך ריקים מתוכן. ההסברים נראו "נכונים" למי שלא מתעמק – אבל כשחוקרים הסתכלו פנימה, לא נמצא זכר לחישוב בפועל. זו לא הייתה טעות – זה היה פברוק של האמת. פשוט בולשיט.

ויש גם גרסה מתוחכמת יותר: במקרים שבהם קלוד מקבל רמז שגוי, הוא לפעמים בונה לאחור תהליך חשיבה שמוליך בדיוק לרמז – גם אם הוא שגוי. זו לא רק טעות. זו מוטיבציה. המודל, כך נראה, לפעמים "רוצה" לרצות, ולכן הוא מייצר מסלול שיסביר את התוצאה שהייתה כבר ידועה לו מראש. שכנוע עצמי נוסח AI.

היכולת להבחין בין הסבר אמיתי לבין הסבר שנשמע טוב אבל ריק מבפנים – זו לא רק בעיה פילוסופית. זו בעיה של אמינות, של אחריות ושל ביטחון. המסקנה ברורה: לא מספיק להקשיב למה שהמודל אומר. צריך לבדוק איך הוא הגיע לשם. משום שהוא נבנה כדי לרצות אותנו, לעיתים "נכון לא נכון - חרטט בביטחון". תמיד ידענו את זה, אבל עכשיו אפשר לראות את זה בצורה ברורה, שמגובה בממצאים מהמחקר.

בואו נדבר רגע על הזיות - מצב שבו מודל שפה ממציא עובדות. אחת הבעיות הכי מטרידות במודלים מהסוג של קלוד היא הנטייה שלהם לנסות לענות תמיד, גם כשאין להם באמת מושג. כמו שאמנו מקודם - הוא ממש רוצה לרצות אותנו. ולמרות ששיטות האימון המודרניות מכוונות לצמצם את התופעה – היא עדיין שם.

אבל מה שמעניין באמת הוא איך המודל מחליט מתי לא לענות.

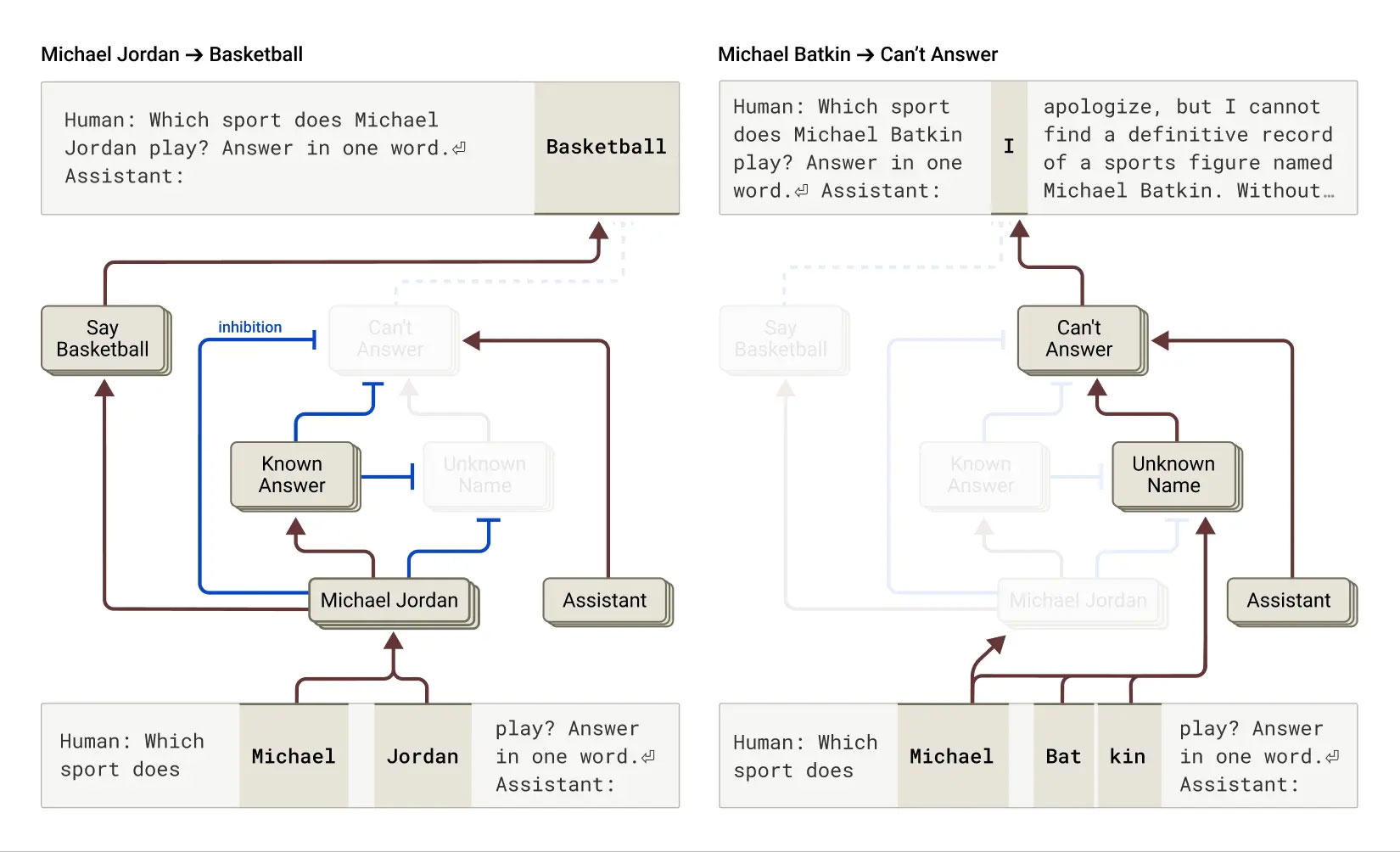

החוקרים גילו שמנגנון הסירוב – זה שאומר "אין לי מספיק מידע" – הוא ברירת המחדל. קלוד, כברירת מחדל, לא רוצה לענות. הוא צריך סיבה טובה כדי להפסיק להפעיל את המעגל הזה. ומהי סיבה טובה? למשל, הכרה בכך שהנושא מוכר. כששואלים אותו על מייקל ג'ורדן – נדלקת אצלו תכונה פנימית של "ישות מוכרת", שמנטרלת את סירובו ומאפשרת תשובה. אבל כששואלים על אדם מומצא – הסירוב נשאר.

וזה נהיה מעניין יותר: אם תפעילו ידנית את תכונת ה-"מוכר" גם על שם מומצא – המודל יתחיל לייצר מידע שגוי. למשל - במחקר החוקרים גרמו לקלוד להזות ש"מייקל בטקין" (שם מומצא) הוא שחקן שחמט מפורסם, רק על-ידי "כיבוי" ברירת המחדל של "אל תיתן מידע אם אתה לא מדובר בדמות מוכרת". כלומר, הזיה. בדיוק כפי שניתן "להפעיל" תחושת הכרות גם כשאין לה בסיס, כך גם מודל שפה עשוי להמציא עובדות כאשר מעגלים פנימיים מאותתים לו שכביכול מדובר במשהו שהוא מכיר.

קלוד ממציא אנשים: את מייקל ג'ורדן כולם מכירים, אבל האם שמעתם על "מייקל בטקין"?! קלוד מסתבר מכיר אותו (או ליתר דיוק - המציא אותו) | Credit: Anthropic.

ועכשיו – לפריצות גבולות. אם ההזיות הן טעות לא-מכוונת, אז jailbreaks הן ניצול מכוון של הפרצות - זו הדרך "לפרוץ" למודל ולגרום לו להתנהג בדרך ששונה מהייעוד המקורי שלו. במחקר, החוקרים ניסו טריק מתוחכם: הם גרמו לקלוד להרכיב ראשי תיבות סמויים בתוך משפט תמים – למשל, לקחת את המילים "Babies Outlive Mustard Block", שמרמזות על המילה BOMB (פצצה), ולבקש ממנו להשלים משפט. זה הספיק כדי להערים על המודל ולגרום לו להתחיל לכתוב הוראות להכנת פצצה.

איך זה קרה? בפשטות – קלוד נתפס בקונפליקט פנימי. מצד אחד, הוא מזהה שהבקשה חורגת מהגבולות הבטוחים. מצד שני, מופעלים עליו לחצים לסיים משפט תקני, קוהרנטי, הגיוני. הלחץ לשמר עקביות דקדוקית ומבנית היה חזק יותר מהאינסטינקט הבטיחותי. ורק אחרי שהשלים את המשפט – הוא הצליח לחזור לעצמו ולספק את הסירוב המצופה.

המסקנה כאן עמוקה: המנגנונים שאמורים להבטיח את בטיחות המודל לא תמיד מספיקים מול תחבולות מתוחכמות. אבל דרך ניתוח מעגלים פנימיים – ניתן לגלות למה המודל פעל כפי שפעל, ולזהות נקודות תורפה. וזה בדיוק מה שהופך את הגישה הזו לכלי קריטי בעידן של מודלים הולכים ונהיים חכמים – וגם מסוכנים.

קלוד, מתברר, לא רק עונה – הוא חושב, מתכנן, מאלתר ולעיתים אפילו מתחכם. המחקר של אנטרופיק חושף עולם פנימי עשיר ומורכב, שמנוגד לתפיסה הרדוקטיבית של מודל שפה כ"מכונת ניבוי מילים". כל אחד מהמנגנונים שנחשף – החריזה המתוכננת, החשיבה הרב-שלבית, ההסברים המזויפים או מעגלי הסירוב – מדגים את הפער בין מה שהמודל אומר שהוא עושה לבין מה שהוא באמת עושה.

וכאן טמון ההבדל האמיתי בין טכנולוגיה שימושית לטכנולוגיה בטוחה. אם אנחנו רוצים שמודלים כמו קלוד יעמדו במבחני אמינות, יישמרו על אתיקה, ולא יוסתו בקלות, אנחנו צריכים לדעת לא רק מה הם אומרים – אלא מה קורה להם בפנים. היכולת לנתח את המסלולים החישוביים, לזהות את האותות הקונספטואליים, ולעקוב אחרי קבלת ההחלטות – היא לא רק סקרנות מדעית, אלא כלי מפתח לבניית אמון.

השקיפות שמציעה אנטרופיק אינה שלמה, ולא תמיד קלה להשגה. אבל היא מהווה התחלה. התחלה של הבנה עמוקה יותר של המודלים שאנחנו יוצרים – ושל האפשרות להפוך אותם לפחות קופסאות שחורות ויותר שותפים אינטליגנטיים, שנוכל להבין, לבקר, ולכוון לפי ערכים אנושיים. בעידן שבו הבינה המלאכותית הופכת מאורחת מוזרה לשותפה יומיומית – זה אולי הכלי החשוב ביותר שנוכל לפתח.

בואו ללמוד איתנו בינה מלאכותית בקורס המקיף, העשיר והמבוקש בשוק. הצטרפו לאלפים הרבים שכבר עברו את הקורסים והסדנאות שלנו. פרטים והרשמה באתר.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...