דף הבית » עדכון חשוב בקלוד – אנטרופיק מאמנת את המודלים שלה על השיחות שלנו!

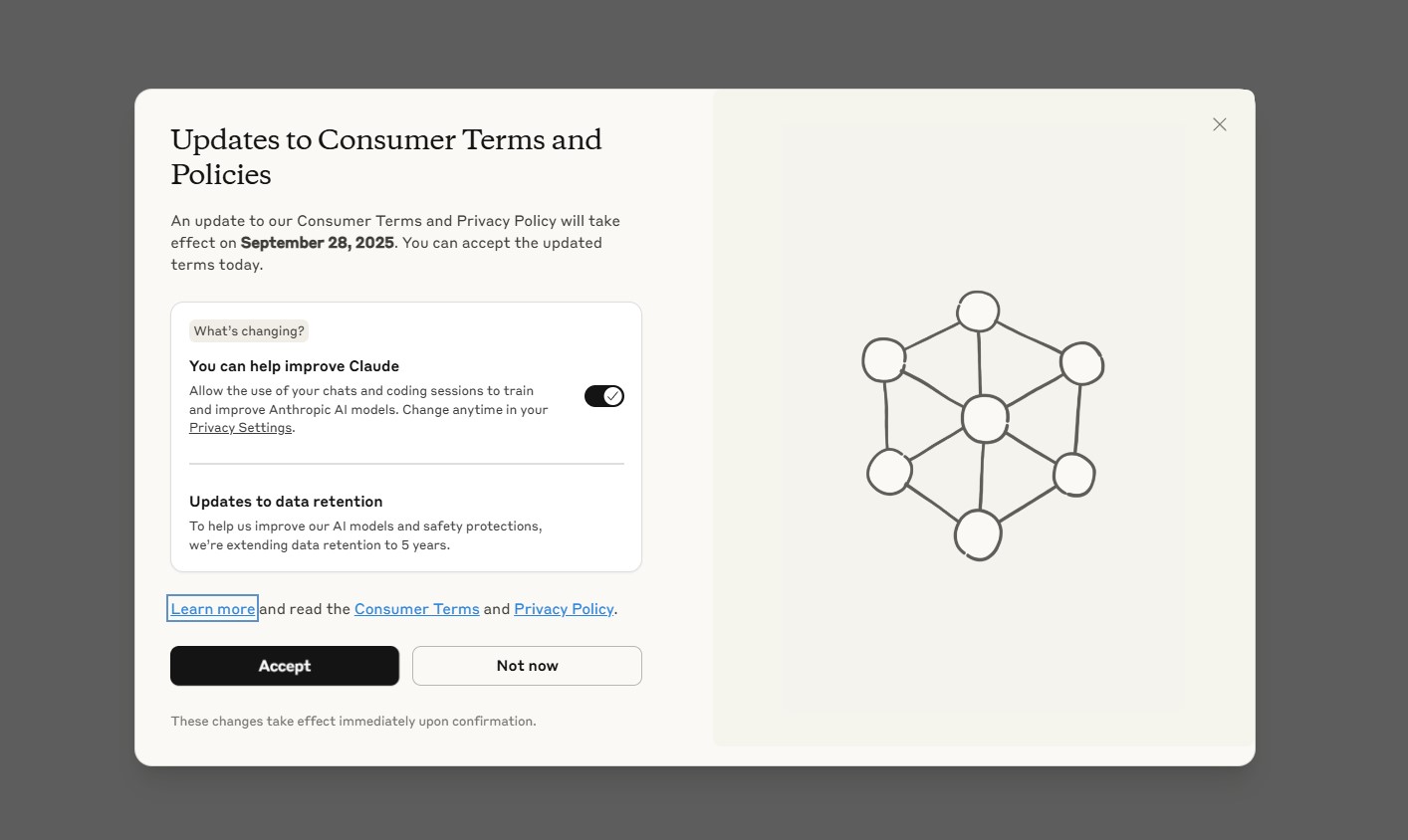

אם גם אתם עובדים עם קלוד (Claude) - מודל השפה המדהים של אנטרופיק, בטח שמתם לב שקיבלתם לאחרונה התראת פופאפ עם הודעה מפתיעה במיוחד: שינוי משמעותי במדיניות הפרטיות ובתנאי השימוש - אבל מה עומד מאחורי ההודעה התמימה למראה? מסתבר שאנטרופיק (Anthropic), החברה שמפתחת את קלוד, משנה כיוון: החל מה-28 בספטמבר 2025, השיחות שלכם עם המודל עשויות להפוך לחומר גלם לאימון גרסאות עתידיות שלו. מדובר בשינוי מהותי בגישת החברה, שבעבר הדגישה את העובדה שהמודלים שלה אינם מאומנים כברירת מחדל על תוכן המשתמשים. כעת, האופציה הזו מופעלת כברירת מחדל - אלא אם תבחרו לכבות אותה באופן יזום בהגדרות הפרטיות שלכם.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

קלוד (Claude) הוא אחד מהצ'טבוטים הג'נרטיביים המובילים בשוק - המתחרה הישיר של ChatGPT, ובעיני רבים - ה-LLM הטוב בעולם!

העדכון מתייחס לכל המשתמשים בשירותי Claude Free, Claude Pro ו-Claude Max, כולל השימוש בכלי Claude Code. המשמעות היא שכל שיחה, קוד, או תוכן שתשתפו עם המודל עשוי לשמש את אנטרופיק כדי לשפר את ביצועי קלוד בעתיד. השינוי לא חל על שירותים מסחריים כמו Claude for Work, Claude Gov, Claude for Education, או שימוש ב-API דרך פלטפורמות כמו Amazon Bedrock ו-Google Cloud Vertex AI.

כחלק מהעדכון, החברה גם מאריכה את פרק הזמן שבו הנתונים נשמרים: במקום 30 יום בלבד, המידע יישמר עד חמש שנים - כל עוד הסכמתם לשימוש בו לצורכי אימון מודלים. אם תבחרו שלא לשתף את הנתונים שלכם לאימון, יישמרו השיחות רק ל-30 יום, כפי שהיה עד כה (בעיקר לצרכי אבטחה ובקרה).

מה זה אומר בפועל? המשמעות היא שלכל המשתמשים קופצת הודעה עם הכניסה לאפליקציה, שבה מוצגת האפשרות להפעיל או לכבות את השימוש בשיחותיהם לאימון המודל, לרבות אישור תנאי השימוש החדשים. אם תאשרו את התנאים החדשים ותשאירו את האפשרות דלוקה, השיחות החדשות או שלכם יוכלו להפוך לחלק מתהליך האימון של אנטרופיק. שיחות ישנות שלא חזרתם אליהן לא ייכנסו לאימון.

פופאפ תמים למראה - מעכשיו ברירת המחדל היא שאנטרופיק מאמנים את המודלים שלהם על הדאטה שלכם, אלא אם תגדירו אחרת!

למי שמעדיף לשמור על פרטיות מלאה, ניתן בכל שלב להיכנס לתפריט ההגדרות (Settings), ללחוץ על "פרטיות" (Privacy), ולכבות את האפשרות שנקראת "Help improve Claude". ברגע שתכבו אותה, הנתונים שלכם לא ייאספו עוד לטובת אימון עתידי.

כמעט כל דבר שאתם כותבים לקלוד - החל משאלות טכניות, התייעצויות עסקיות, מידע פיננסי או משפטי, רעיונות מקוריים, ועד מסמכים פנימיים של הלקוחות שלכם - עשוי להיאגר ולשמש כחומר גלם לאימון. גם אם אנטרופיק משתמשת בכלים אוטומטיים לסינון או טשטוש מידע רגיש, מדובר בצעד משמעותי שמציב שאלות אמיתיות על גבולות הפרטיות של המשתמשים.

ראוי להדגיש: אנטרופיק מציינת במפורש כי היא אינה מוכרת את המידע לצדדים שלישיים. המטרה שלה היא לשפר את יכולות המודל, להגביר את הבטיחות שלו ולהפחית מקרים של שימוש לרעה, כמו הונאות, ספאם או הפצה של תכנים מזיקים. עם זאת, מהבחינה הפרקטית, כל מידע שתשאירו במערכת עלול להוות חלק מאימון עתידי, אלא אם תגדירו אחרת.

החברה מנמקת את השינוי בצורך לשפר את המודלים באמצעות אינטראקציות אמיתיות עם משתמשים. כמו חברות אחרות בתחום, גם אנטרופיק טוענת כי מידע כזה חיוני כדי לחדד את היכולות של המודל, בין אם מדובר בכתיבת קוד, ביצוע ניתוחים מורכבים או שיפור יכולות ההבנה וההיגיון. מעבר לכך, הארכת תקופת שמירת המידע לחמש שנים מאפשרת לחברה לעבוד עם מאגר נתונים עקבי ורחב יותר לאורך זמן. כך ניתן לשפר את המודלים בצורה רציפה, לזהות דפוסי שימוש בעייתיים ולבנות מערכות סינון מתקדמות יותר נגד שימוש לרעה.

בעולם תחרותי בו חברות ענק נלחמות על המטבע היקר מכל - דאטה - כל פיסת מידע ודפוס שימוש, הופך להיות מכשיר חיוני במרוץ ליצירת ה-AGI או ה-ASI הראשון. אנטרופיק אמנם פחות מבליטה את הרצון שלה לייצר אינטליגנציית על שכזו (בניגוד לסם אלטמן מ-OpenAI, מארק צוקרברג מ-Meta, או אילון מאסק מ-xAI), אבל ניכר שהיא לא יכולה להתעלם מהכיוון שכל ענקיות ה-AI לוקוחת!

ת. אם תכבו את האפשרות "Help improve Claude", השיחות שלכם יישמרו רק ל-30 יום לצורכי תפעול ושירות, ולא ייכנסו לאימון המודל.

ת. לא. רק שיחות חדשות או כאלה שתמשיכו בהן לאחר השינוי עשויות לשמש לאימון. תוכן ישן ללא פעילות לא ישמש את החברה.

ת. כן. בכל שלב אפשר להיכנס להגדרות הפרטיות ולשנות את ההעדפה. אם תחליטו לכבות את ההגדרה בעתיד, השיחות החדשות לא ייכנסו לאימון, אך תוכן שכבר נאגר ונעשה בו שימוש יישאר כחלק מהמודלים שכבר אומנו.

ת. השינוי לא חל על משתמשי Claude for Work (צוותים וארגונים), ולא על שימוש ב-API דרך ענן כמו Amazon Bedrock. לקוחות עסקיים ימשיכו לפעול תחת תנאי שימוש אחרים.

נראה שאנטרופיק מאמצת גישה דומה לזו של חברות מתחרות, המסתמכות על אינטראקציות אנושיות ואגירת דאטה משיחות לשיפור המודלים שלהן. לכן, אם אתם עובדים עם מידע רגיש, מומלץ לאשר את תנאי השימוש החדשים כדי להמשיך לעבוד עם קלוד, אך מיד להיכנס להגדרות הפרטיות ולכבות את האפשרות "Help improve Claude". פעולה זו לוקחת פחות מעשר שניות, והיא הדרך הבטוחה ביותר לשמור על השליטה בנתונים שלכם.

להרחבה, מוזמנים לעיין במסמכים הרשמיים שאנטרופיק פרסמה:

בואו ללמוד איתנו בינה מלאכותית בקורס המקיף, העשיר והמבוקש בשוק. הצטרפו לאלפים הרבים שכבר עברו את הקורסים והסדנאות שלנו. פרטים והרשמה באתר.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...