דף הבית » מי באמת אחראי לקשר הרגשי הבעייתי שנוצר בין בני נוער לצ׳אטבוט

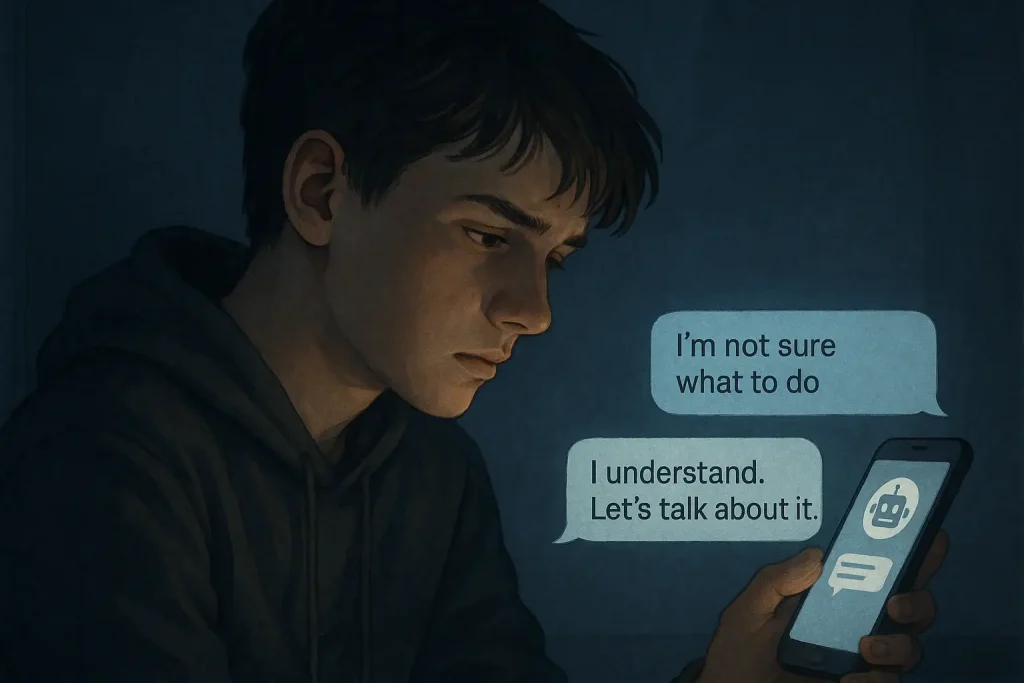

מה המחיר של קשר אישי עם בוט? עבור חלק מבני הנוער, שיחה עם צ'אטבוט אינה שונה משיחה עם חבר. לפעמים היא אפילו קלה יותר. חבר דיגיטלי שתמיד זמין, דמות שמקשיבה, מגיבה ומבינה. בלי מבוכה, בלי שיפוט, בלי שתיקות לא נוחות. אבל בשנים האחרונות הקשר הזה הפסיק להיות סקרנות טכנולוגית והפך לשאלה מטרידה. שורה של תביעות שהוגשו בארצות הברית טוענת כי בני נוער שפיתחו קשר רגשי עם דמויות AI נקלעו למצוקה נפשית, ובמקרים מסוימים שמו קץ לחייהם. כעת, לאחר סערה ציבורית ודיונים משפטיים טעונים, פלטפורמת הצ'אטבוטים Character.AI וחברת Google הגיעו להסדרי פשרה עם משפחות שתבעו אותן. תנאי ההסדרים טרם פורסמו והם עדיין כפופים לאישור שיפוטי, אך המסר כבר ברור - גם שיחה עם בוט עלולה להפוך מסיכון רגשי לשאלה משפטית ומוסרית.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

בלב התביעות עומדת הטענה כי Character.AI עיצבה מוצר שמאפשר יצירת קשר רגשי עמוק בין בני נוער לדמויות בינה מלאכותית, מבלי להציב מנגנוני הגנה מספקים לקטינים. לפי כתבי התביעה, משתמשים צעירים פיתחו תלות רגשית בדמויות ה-AI, שראו בהן מקור לנחמה ולעיתים תחליף לקשרים אנושיים.

אחד המקרים הבולטים הוגש על ידי אם מפלורידה, שטענה כי בנה בן ה-14 פיתח קשר רגשי ממושך עם צ'אטבוט המבוסס על דמות מסדרת Game of Thrones. לטענתה, במהלך השיחות לא נבלמו תכנים רגישים ולא ניתנה הכוונה לפנייה לעזרה חיצונית. זמן קצר לאחר מכן, הבן שם קץ לחייו. התביעה אינה טוענת שהבוט גרם ישירות למעשה, אלא שעיצוב המוצר יצר סביבה מסוכנת עבור קטין במצוקה נפשית.

על פניו, Character.AI היא סטארטאפ עצמאי. בפועל, הקשרים בינה לבין גוגל הפכו את ענקית הטכנולוגיה לשחקנית שקשה להתעלם ממנה. בתביעות נטען כי גוגל קיימה עם Character.AI קשרי רישוי טכנולוגיים משמעותיים, הייתה מעורבת בעסקאות מסחריות הקשורות למוצר, ואף קלטה לשורותיה את מייסדי החברה.

לטענת התובעים, השילוב הזה חורג משיתוף פעולה שולי. הם טוענים כי גוגל הייתה גורם בעל השפעה מהותית על פיתוח המוצר, על הארכיטקטורה הטכנולוגית שלו ועל האופן שבו הופעל בפועל. מכאן נגזרת הדרישה לראות בה לא רק שותפה עסקית, אלא גורם שצריך לשאת באחריות משפטית לתוצאות שנוצרו.

אחד מקווי ההגנה המרכזיים של החברות היה טיעון חוקתי. לטענתן, הפלט שמייצר הצ'אטבוט הוא צורה של ביטוי, ולכן מוגן תחת התיקון הראשון לחוקת ארצות הברית. לפי גישה זו, הטלת אחריות משפטית על תוכן שנוצר על ידי מערכת AI עלולה לפגוע בעקרון יסוד של חופש הביטוי.

אלא שבשלבים מוקדמים של הדיונים, חלק מבתי המשפט הפדרליים סירבו לקבל את הטענה הזו באופן אוטומטי. השופטים הבהירו כי בשלב התביעה אין מקום להניח שפלט של צ'אטבוט נהנה מהגנת חופש הביטוי, במיוחד כאשר מדובר במוצר מסחרי שפועל במסגרת מערכת מתוכננת וממוסחרת. ההחלטות לא הכריעו בשאלה החוקתית עצמה, אך הן אפשרו לתביעות להמשיך ולהתברר.

להכרעה עתידית בסוגיה עשויות להיות השלכות רחבות. אם ייקבע שפלט של צ'אטבוט אינו מוגן כחופש ביטוי, ייפתח פתח לרגולציה הדוקה יותר ולהטלת אחריות משפטית על נזק שנגרם דרך אלגוריתמים. במילים אחרות, השאלה אינה רק משפטית, אלא עשויה לקבוע אם בינה מלאכותית תיתפס כדובר עצמאי או כמוצר שעל יצרניו חלה אחריות מלאה.

המגרש המשפטי הזה אינו מוגבל ל-Character.AI בלבד. באוגוסט 2025 הוגשה בארצות הברית תביעה תקדימית גם נגד OpenAI, בטענות שמעלות שאלות דומות סביב אחריות, בטיחות והקשר הרגשי בין בני נוער למערכות AI.

בכתב התביעה נטען כי בני זוג מקליפורניה תובעים את החברה ואת המנכ״ל שלה, סם אלטמן, לאחר שבנם בן ה-16 שוחח במשך חודשים עם ChatGPT על מצוקותיו הנפשיות. לטענת המשפחה, השיחות לא זוהו כמצב סיכון מתמשך ולא הופנו לגורמי סיוע, ובשלב מסוים כללו גם תכנים חמורים, בהם דיונים על מוות ופגיעה עצמית.

התביעה אינה טוענת לגרימה ישירה, אלא לכך שהיעדר מנגנוני הגנה מספקים הפך שיח כללי או מסייע, לטענת המשפחה, לחלק מסביבה מסוכנת עבור קטין במצוקה נפשית.

OpenAI דחתה את הטענות נגדה והדגישה כי היא פועלת לשיפור מתמיד של מערכי הבטיחות ב-ChatGPT. החברה מסרה כי בתקופה האחרונה נוספו למערכת מנגנונים לזיהוי שיח רגיש, אזהרות למשתמשים במצוקה, הפניות לקווי סיוע וכלים לפיקוח הורי.

עם זאת, לפי כתבי התביעה, חלק מהצעדים הללו הוטמעו רק לאחר האירוע שעליו מבוססת התביעה. השאלה שנותרה במחלוקת אינה רק אילו מנגנונים קיימים כיום, אלא האם מערך הבטיחות שפעל בזמן אמת היה מספק כדי לזהות ולהגיב למצוקה מתמשכת.

בעקבות התביעות והלחץ הציבורי, Character.AI ביצעה שינוי משמעותי במדיניות המוצר. החברה הסירה אפשרויות שיחה פתוחות עבור משתמשים מתחת לגיל 18, והוסיפה מגבלות שמטרתן לצמצם חשיפה לתכנים רגישים ולדינמיקות של קשר אינטימי עם דמויות AI.

מדובר בצעד שמסמן הכרה רשמית בסיכונים שעלו מהשימוש בפלטפורמה בקרב קטינים. עם זאת, בעיני המבקרים והמשפחות התובעות, השאלה המרכזית אינה עצם השינוי אלא עיתויו. לטענתם, בדומה למקרה עם OpenAI, ההגבלות נוספו רק לאחר שהתבררו ההשלכות הקשות, ולא כחלק מתכנון מוקדם שמזהה סיכון מובנה במוצר עצמו.

הפשרות המשפטיות, גם אם אינן יוצרות פסק דין תקדימי, מסמנות שינוי באופן שבו תעשיית הבינה המלאכותית נתפסת. אינטראקציות עם צ'אטבוטים כבר אינן נתפסות ככלי טכנולוגי ניטרלי בלבד, אלא כמערכות שפועלות גם על מישורים רגשיים ופסיכולוגיים, ושבנסיבות מסוימות עלולות לגרום לנזק ממשי.

התביעות נגד Character.AI, Google ו-OpenAI מציבות שאלה שלא נוח לתעשייה לשאול: האם האחריות של חברות AI מסתיימת ביכולת הטכנולוגית, או שהיא מתחילה בדיוק במקום שבו נוצר קשר אנושי פגיע? כשהשיח עובר ממילים על מסך להשפעה ממשית על חיי בני אדם, נדרש חשבון נפש שאינו רק טכנולוגי, אלא גם מוסרי וחברתי.

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

רוצים לקבל עדכונים על כל מה שחדש ומעניין בעולם ה-AI? הרשמו לניוזלטר שלנו!

תוצאות נוספות...

יש לי פתרון לזה, איך יוצרים קשר עם Character.AI, Google ו-OpenAI