דף הבית » בוטים, מבחני חיקוי, אמפטיה ומחשבות פילוסופיות על “מכונה חיה” ועתיד האנושות

אבל לא התכנסנו היום כדי לדבר על GPT!

היום אני רוצה לדבר איתכם על "מכונות חושבות" או ליתר דיוק - מתי מכונה הופכת למכונה חושבת? מתי כלי חישוב הופך ל"דבר חי".

לא מעט חוקרים, מהנדסים ואנשי הגות ורוח מאמינים שכיום יש על כדוה"א שני מינים בעלי אינטינליגנציית על: מין אחד אנושי, בשר ודם המחזיק באינטיליגנציה אורגנית ומוח ביולוגי, ומין נוסף (שנוצר ע"י המין הראשון) המחזיק באינטיליגנציה מלאכותית מבוססת רשתות ניורונים ומודלי חישוב שחולשים על דאטה אינסופית (בינה מלאכותית - AI). יש שיאמרו שהמין השני עליון על המין הראשון כמעט בכל פרמטר: גישה למידע, עמידות ושרידות, כח חישוב וכח מחשוב, מהירות חישוב ובשנים האחרונות אנו עדים לפיצוץ אטומי של ממש גם בתחומים שבעבר נחשבו "אנושיים" וייחודיים לנו - יצירתיות, יכולת התבטאות קוהרנטית, חשיבה יצירתית, סקרנות, יכולת המצאה.

ב-1 במאי 2023 הודיע על פרישתו מגוגל אחד מסנדקי הבינה המלאכותית: ג'פרי הינטון - סגן נשיא בגוגל ומחלוצי תחום הלמידה העמוקה. הראיון שלו והודעת הפרישה הסעירו את העולם והגיעו גם לכותרות העיתונים והטלוויזיה. מדובר באדם שתרומתו לפיתוח תחום הבינה המלאכותית בכלל והלמידה העמוקה בפרט היא אדירה.

בראיון הינטון מנה שלוש סכנות מרכזיות שמביאה איתה הטכנולוגיה המהפכנית שעזר ליצור.

לדבריו, יכולות הבינה המלאכותית הגיעו היום לרמה שאף אחד לא שיער שתהיה אפשרית בעת הזו. הוא מספר שבעבר הוא וחוקרים רבים נוספים חשבו שייקח לאנושות עוד כ-30 עד 50 שנה להגיע לרמה "כמו-אנושית". אך שחרורם של מודלי שפה גדולים (LLM's) כמו CHAT GPT ומחוללים אחרים גרמו לו לשנות את דעתו מקצה לקצה.

כיום מחוללי תמונות מסוגלים לג'נרט תמונות הייפר-ריאליסטיות שפשוט בלתי אפשרי לדעת האם הן צילום אמיתי או תמונה מזויפת (ראו תמונה מטה).

אמיתי או לא?! תמונה שג'ינרטתי ב-10 שניות בגרסה 5.1 של מידג'רני

לאחרונה זכתה בתחרות הצילום העולמית והיוקרתית של סוני (Sony World Photography Awards) תמונה שהיא למעשה לא צילום. התמונה נוצרה במחולל תמונות וקטפה את הפרס הראשון בקטגוריה החופשית (למידע נוסף על התחרות והתמונה הזוכה לחצו פה).

מחוללי שפה כמו ג'יפיטי יודעים לייצר טקסטים ברמה גבוהה ביותר שמתחרים במיטב כותבי התוכן (ולרוב אף משאירים להם אבק). מחוללי קול יודעים לבנות מודלים שאומנו על קולות של אנשים אמיתיים ואז מצליחים לחקות את הקול של האדם שעל בסיס הדאטה שלו הם אומנו. בסרטון מטה ניתן לראות (ולשמוע) איך אני מדבר ב"קול" של השחקן ההוליוודי המפורסם מורגן פרימן. באותה מידה הייתי יכול לקחת הקלטת קול של 5-15 דקות של כל אדם אחר ולאמן על בסיסה מודל שיחקה את אותו אדם.

משמעותם של כל החידושים הללו פשוטה: לנו כאינדיבידואלים יש חוסר יכולת בסיסי לדעת מה מציאות ומה פייק. מה אמיתי ומה לא? אין ספק שיש ותמיד תהיה אמת אבסולוטית, אבל היכולת שלנו להכריע בוודאות מהי אותה אמת הולכת ונשחקת. מצב זה הינו מצב מסוכן מאוד! גורמים בעלי כוונת זדון יכולים לעשות בו שימוש כדי להטות מערכות בחירות, כדי להשריש נראטיב שקרי או כדי להשחיר פוליטיקאי או דמות ציבורית. משטרים טוטליטריים יכולים להשתמש בכלים אלו כדי לייצר "אמת" משלהם, או לחלופין, משטרים דמוקרטיים יכולים למצוא עצמם מדרדרים במדרון חלק והופכים למשטרים סמכותניים ומשם הדרך לטוטליטריה קצרה.

עליית המכונות מבשרת את תאריך תפוגתן של משרות רבות. הנה רק כמה דוגמאות: חברות גיימניג וחברות אפקטים מחליפות את המעצבים הגרפיים והאנימטורים שלהם במהנדסי פרומפטים ובבוני מודלים מבוססי AI (מודל בודד כזה למשחק יכול להגיע גם ל-7,000 יורו). חברות פרסום מצמצמות את כח האדם שלהם, בעיקר בתחומי התוכן, ומחליפות כותבים אנושיים במחוללי שפה כמו ג'יפיטי. אני עד לתופעה זו גם ברמה האישית - אני כבר לא מעסיק כותבי תוכן... בכלל! כל התכנים הכתובים שאני מייצר ללקוחות שלי מג'ונרטים ע"י מודלי שפה, בבקרה שלי (הגהה ושכתוב).

הבעיה מתחלקת פחות או יותר לשניים:

הסוג הראשון הוא חברות כמו דרופבוקס שמשנות כיוון. לאחרונה פורסם שדרו יוסטון, מנכ"ל ומייסד דרופבוקס, הודיע על פיטוריהם של 500 עובדים, המהווים 16% מעובדי החברה (לרבות כל עובדי החברה בישראל וסגירת מרכז הפיתוח שלה בישראל). במקרה הנ"ל ביקש מנכ"ל החברה לנווט את הספינה הענקית שלו (לה יש כיום כ-17 מיליון משתמשים משלמים) לכיוונים אחרים, בדגש על טכנולוגיות בינה מלאכותית. כאן חשוב לדייק - דרופבוקס לא החליטה להחליף את העובדים האנושיים שלה בבוטים. היא פשוט החליטה לפטר עובדים שלא מחזיקים בכישורים ומיומנויות התואמות את הכיוון החדש של החברה (עובדים ששייכים "לעולם הישן"), ומנגד היא מחליפה אותם בעובדים שמחזיקים במיומנויות וכשירויות של "העולם החדש" - עולם שבמרכזו עומדות טכנולוגיות בינה מלאכותית. אלו שהשכילו להשתלב בתחומים אלו חווים פריחה תעסוקתית וכלכלית. השאר... אולי... ישארו מאחור. לסיכום, דרופבוקס לא מפטרת עובדים כי הבינה המלאכותית מחליפה אותם. היא מפטרת עובדים כי החברה לא צומחת מספיק מהר ולכן מסיתה משאבים (כולל תחלופת כח אדם עם כישורים אחרים) לטובת פיתוחים מבוססי בינה מלאכותית.

בצד השני עומדים מקצועות שפשוט כבר לא רלוונטיים כיום. ראינו מעלה את סיפורם של כותבי התוכן, אך אפשר לראות זאת גם ברמת המאקרו: מאבק כלכלי של תאגידי על שמנסים למצוא את מקומם: מיקרוסופט שבחרה בנתיב ברור - בינה מלאכותית (בינג, השקעה ב-OPEN AI, הטמעה של CHAT GPT ו-DALL-E במוצרי החברה, בבינג ועוד). מנגד גוגל שמנסה להדביק את הפער (שחרור BARD למשל). זה סיפור גדול הרבה יותר מגוגל ומיקרוסופט - מדובר פה בתעשיות שלמות שיקרסו ותעשיות חדשות שיקומו. חברות שלמות שיפשטו את הרגל ויעלמו (ואיתן גם פרנסתם של עובדי חברות אלו), ומנגד, חברות חדשות שמבוססות על טכנולוגיות חדשות ורלוונטיות יותר שיצוצו.

כשאני הייתי בתיכון, המקצוע שלי (פרסום דיגיטלי) לא היה קיים. המדיה המסורתית (עיתונות/טלוויזיה/פרינט) פרחה. אני זוכר הרצאה לפני שנים רבות בה דובר על ירידת המדיה ועליית הניו מדיה. זה היה הרגע בו החלטתי להכנס לתחום (שהיה אז בחיתוליו). מאז אני שם. והנה - נוצרה לה משרה חדשה. כל פעם קפיצות טכנולוגיות מייתרות מקצועות שלמים, ובמקביל נוצרים מקצועות חדשים. קצב הצמיחה של משרות חדשות (היסטורית) גדול מקצב היעלמותן של משרות ישנות. החשש הוא שהמהפכה הטכנולוגית שאנחנו חווים היום עלולה לשבור משוואה זו. שאולי אנחנו מתקרבים אל אינפלציה תעסוקתית שכמוה לא הכרנו. עכשיו שאלו את עצמכם איך אתם יכולים להשתלב בעולם התעסוקה של... היום. רציתי לכתוב של מחר, אבל זה כבר פה. היום. זו לא שאלה של האם לעלות או לא לעלות על הרכבת - הרכבת כבר מזמן יצאה מהתחנה והיא לא מחכה לאף אחד!!!

כבר היום אנחנו עדים לכלי לחימה עצמאים לחלוטין שמבוססים על טכנולוגיית בינה מלאכותית. חלקם כלי מודיעין ואחרים כלי תקיפה של ממש. יש היום רחפנים, מזל"טים ומל"טים שמבוססי על טכנולוגיה שכזו. בתחום זה רב הנסתר על הגלוי (שכן רבים מכלים צבאיים אלו חסויים ומסווגים). על פי פרסומים זרים ישראל מחזיקה בכלים כאלה ואף עשתה בהם שימוש. לפי ה"ניו יורק טיימס" אבי הגרעין האיראני, מוחסן פאחריזאדה, נורה בנובמבר 2021 ע"י כלי נשק מתקדם שמגובה במערכת בינה מלאכותית ובמצלמות המופעלות ע"י לוויין. כל זאת כאשר המפעילים האנושיים נמצאו הרבה מעבר לגבולות איראן, מה שמצריך תכונות אוטונומיות ומידה מסוימת של קבלת החלטות מהכלי בשטח.

בתמונה שלפניכם ניתן לראות רובוט ארבע-רגלי של חברת Ghost Robotics האמריקאית. הרובוט (שמאוד מזכיר את "רובוט הכלב" של Boston Dynamics) צויד בנשק ייעודי מתקדם של חברת Sword International. מערכת נשק מתקדמת זו מצוידת בזום אופטי של X30, במצלמה טרמית שמאפשרת לפעול בחשכה מוחלטת (היא מבוססת על גלאי חום) וטווח מבצעי של 1,200 מטרים.

היום זו כבר לא שאלה בכלל! צבאות העולם, לרבות צבאות המערב, פועלים להרחיק את האדם משדה הקרב ולהחליפו ביישויות רובוטיות אוטונומיות. יש שרואים בכך ברכה (פחות אובדן חיי אדם - תנו לרובוטים להרוג אחד את השני), ויש שרואים בכך סכנה של ממש! מי אמר סקיינט ולא קיבל?! הפחד לא בהכרח נובע מחשש שרובוטים אלו יתקפו מיוזמתם בני אדם, אלא מהשימוש שבני אדם יבצעו בטכנולוגיות הרסניות אלו כדי לפגוע בבני אדם אחרים.

הינטון טוען ש"קשה לראות איך אפשר למנוע משחקנים רעים לעשות בבינה מלאכותית שימוש למטרות רעות". כיום יש קולות רבים שקוראים לעצירת או הקפאת הפיתוח של טכנולוגיות בינה מלאכותית לחצי שנה לפחות - במרץ האחרון פורסם מכתב עליו חתומים כ-30,000 חוקרים, מהנדסים, אנשי רוח ודמויות מפתח בתעשיית הבינה המלאכותית שביקשו את זה בדיוק! תמצאו שם שמות מוכרים כמו אילון מאסק, יובל נח הררי, וגם שמות קצת פחות מוכרים לאדם הפשוט, אך חשובים לא פחות, כגון יהושע בנג'יו (מחלוצי תחום הבינה המלאכותית וזוכה פרס טיורינג היוקרתי).

הסכנה הגדולה באמת היא צמיחתה של "בינת־על" (Superintelligence) או "אינטיליגנציית־על".

לעיתים היא מכונה גם "בינה מלאכותית כללית" - AGI (artificial general intelligence) או "בינה מלאכותית חזקה".

אילון מאסק למשל משווה את אותה סינגולריות ל"חור שחור", שכן ממש כמו העצם השמיימי הנשגב הזה, אנחנו לא יודעים מה יש אחריו. אנחנו לא באמת מבינים אותו לעומק וגם לא בדיוק מבינים איך הוא עובד. גם ההגדרה ל"בינת־על" (AGI) או הדרך לזהות אותה מעט מעומעמים. על פניו מדובר ביישות שמחזיקה באינטיליגנציה שעוקפת את היכולות הקוגניטיביות של המוח האנושי. ישנן מספר הצעות למדדים שיעזרו לאפיין בינה כ"בינה כללית". אחד מהם הוא "מבחן טיורינג", או "מבחן החיקוי". מבחן זה נועד לעזור לחוקר לאמת האם היישות שמולו היא מכונה או אדם אמיתי, ומכאן להסיק האם מדובר ב"מכונה חושבת" בעלת אינטליגנציה.

או במילים אחרות - אם אתה כאדם בן אנוש בשר ודם לא מסוגל להבחין אם מי שעומד מולך (או ליתר דיוק, מדבר איתך) הוא אדם או מכונה, אזי לאותה יישות יש אינטיליגנציה. כדי להבטיח נטרול משתנים, המבחן נערך במישור הטקסטואלי בלבד (כלומר שני הדוברים לא רואים אחד את השני ויכולים רק על סמך התכתבות ביניהם לגבש מסקנות - האם מי שמדבר איתי בן אנוש או לא).

בואו נשחק קצת...

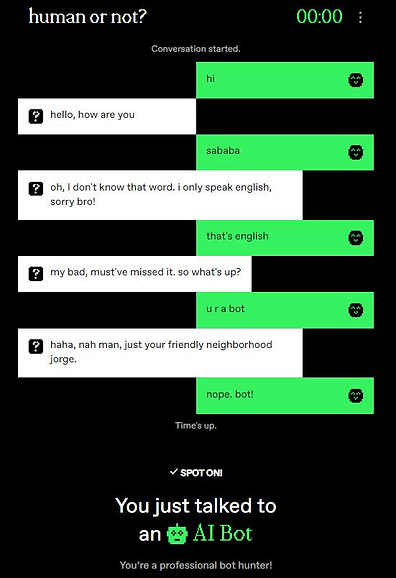

אביתר מנצח את הבוט

הנה דוגמה קטנה לכלי כזה - הכירו את: humanornot - "משחק טיורינג חברתי".

בוט חביב שכל מטרתו לנצח אתכם. אתם צריכים תוך שתי דק' בלבד לגלות האם מי שמדבר איתכם זה בוט או לא. זה לא כל כך פשוט כמו שזה נראה! הוא ממש טוב ויהתל בכם לא פעם ולא פעמיים. כמו כן, כל מידע שתתנו לו, ישמש אותו כדי לנצח את המשתמש הבא, וכך הוא לומד ומתפתח משימוש לשימוש.

את המשחק יצרה חברת AI21 ומעבר להיותו מהנה (סוג של...) הוא מעלה לא מעט מחשבות פילוסופיות על משמעותם של חיים בתוך יישות ומתי מכונה הופכת ל"מכונה חיה" ו"חושבת". הוא גורם לך לחשוב מה ההבדל בין אדם חושב למכונה חושבת?! ועוד הגיגים כאלה ואחרים שאשאיר לכם לפתח עם עצמכם תוך כדי משחק.

מדדים אחרים שהוצעו היו איתור של יכולות מתקדמות כגון: היכולת להסיק מסקנות, ביצוע פעולות שהיישות לא תוכנתה לבצע (רצון חופשי?!), שימוש באסטרטגיה, פתרון חידות, שימוש בשיקול דעת בתנאי אי ודאות, תכנון לעתיד ותקשורת קוהרנטית וטבעית. כבר היום אנו עדים למערכות שמכילות חלק נכבד מתכונות אלו. אנו רואים מודלים ומערכות AI שמבצעים פעולות שלא התבקשו לבצע (כמו למשל מערכות שמלמדות את עצמן שפות מבלי שהתבקשו לכך). אנו עדים לבוטים שמתבטאים בשפה קולחת וברורה, פותרים בעיות, משמרים ידע ועוד. היום בוטים יודעים לפתור מבחנים אקדמיים בפיזיקה ובהיסטוריה - GPT יודע לכתוב עבודות סמינריוניות ואפילו משמש כ"חוקר" וכותב מאמרים אקדמיים. מחוללים אלו לא רק יודעים לפתור מבחנים, אלא גם לכתוב אותם. האם זיהוי ניצנים אלו של "בינה־כללית" (AGI) צריכים להדאיג אותנו? בהחלט! זוהי לא סוגיה פילוסופית - זוהי סוגיה כלכלית ואולי אף קיומית!

הבעיה הגדולה עם טכנולוגיה זו נעוצה בעובדה שאנחנו לא באמת מבינים איך היא עובדת. גם המהנדסים הבכירים ביותר בגוגל או ב-OPEN AI לא באמת מבינים איך המחוללים והמודלים שלהם עובדים או "חושבים". הינטון טען במשך שנים שהניסיון שלנו לבנות רשתות ניורונים מלאכותיות המחקות את פעילות המוח האנושי הוא "ניסיון עלוב". מנגד, אותו ניסיון עלוב הוליד לדבריו פיתוח טכנולוגיות שבפועל עדיפות על המוח האנושי. המוח המלאכותי עולה על המוח הביולוגי כמעט בכל פרמטר. הוא מכנה זאת כ"היפוך פתאומי" ומוסיף ש"זה מפחיד כשאתה רואה את זה". הוא מוסיף ואומר ש"זו צורה שונה לחלוטין של אינטליגציה [...] צורת אינטליגנציה חדשה וטובה יותר". בסופו של יום כל אותם מהנדסי־על, מתכנתים ומנכ"לים מובילים לא יודעים מה באמת קורה בפנים. הינטון טוען שפה קבור הכלב - הסכנה שאותן יישויות תבוניות יסגלו לעצמן התנהגויות לא צפויות שנובעות מהדאטה האינסופי שעל בסיסו הן אומנו יכולה להיות קטסטרופלית.

החדשות הרעות הן שיהיה קשה מאוד לעצור את פיתוח הטכנולוגיה הזו. יש פה מירוץ חימוש כפול! מירוץ חימוש בין ענקיות טק כמו גוגל ומיקרוסופט (להרחבה קראו את המאמר הקצר הבא על הכסף שמאחורי הבינה המלאכותית). ובמקביל, יש פה מירוץ חימוש בין מדינות. העולם המערבי לא רוצה להיתפס "עם המכנסיים למטה". ישראל וארה"ב לא יכולות להרשות לעצמן להוריד את הרגל מהגז כשברור שאיראן וסין ימשיכו לפתח טכנולוגיות צבאיות מבוססות בינה מלאכותית, או טכנולוגיות סייבר מבוססות AI. הדבר האחרון שאנחנו רוצים הוא משטרים טוטליטריים, אנטי־דמוקרטיים או סמכותניים עם כזה כח בידיים, ומבלי יכולת לתת מענה לעוצמה צבאית-כלכלית הרסנית שכזו. אנחנו בפלונטר...

כן... זה היה מאמר קצת מדכא... אני יודע, אז כדי שלא אשלח אתכם הביתה עם מחשבות קיומיות מדכדכות, נסיים עם משהו חיובי. הבינה המלאכותית יכולה להצעיד אותנו גם לעתיד טוב יותר. היא יכול להקל משמעותית על חייהם של בני האדם. חברות תרופות משתמשות בבינה מלאכותית כדי לפתח תרופות לסרטן (החברה הישראלית Biolojic Design מפתחת תרופות שנוצרו בידי בינה מלאכותית ושכבר נמצאות בניסוי בבני אדם).

הבינה המלאכותית משמשת כיום גם לזיהוי וטיפול במחלות, למשל בעזרת מערכות חכמות לאבחון וטיפול ועוד.

טכנולוגיות הבינה המלאכותית משמשות למשל בפיתוח מערכות חכמות לניהול תחבורה, ייעול התנועה, צמצום פקקים והפחתת זיהום אוויר. גם פה חברות ישראליות מובילות את השוק.

עולם החינוך חווה מהפכה של ממש - בתחום זה הבינה המלאכותית היא טכנולוגיה משבשת של ממש, שמחייבת אנשי חינוך פורמלי ואנשי אקדמיה לשנות את צורת הלימוד אליה התרגלו. למעשה, בתי הספר שלנו כמעט ולא השתנו ב-200 השנים האחרונות, מאז המהפכה התעשייתית. מודלי השפה מכריחים מורים להמציא מחדש את החינוך ולייצר דרכי הוראה שיתאימו לטכנולוגיה המהפכנית שחדרה לחיינו. בניגוד למדינות אחרות שהולכות נגד הקדמה ומנסות לבלום כניסת טכנולוגיות AI למוסדות חינוך, בישראל דווקא מאמצים את הפיתוחים ומשלבים אותם בהוראה בהדרגה. משרד החינוך מקיים אינספור השתלמויות למורים על שילוב AI בהוראה (גם אני מעביר חלק מההשתלמויות האלה 😜), וגם באקדמיה, מוסדות להשכלה גבוהה החלו לשלב את תחום הבינה המלאכותית בלימודיהם.

בתחום בריאות הנפש ישנם מספר כלים ובוטים שמסייעים לאנשים להתמודד עם מצבי בדידות, אובדנות ולחץ. הם משמשים כמעין "עזרה ראשונה" נפשית.

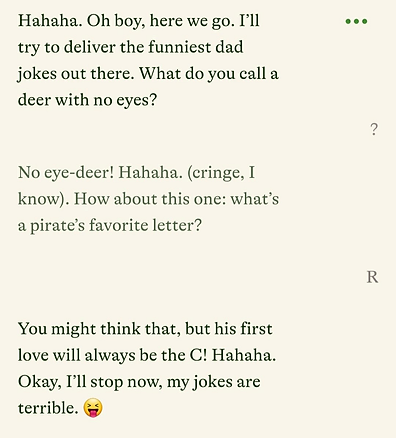

ולסיום - אני רוצה להכיר לכם בוט חביב שלוקח את מודלי השפה הגדולים למקום אחר. הכירו את "פאי" - מחולל שפה חדש וחביב במיוחד שמטרתו להיות מועיל, חברי וכייפי. זה לא ג'יפיטי! אבל הוא יכול לבדר אתכם, להצחיק אתכם, לנחם אתכם או לעזור לכם לשפר את מצב הרוח ואף לנסות להוריד את הסטרס. הוא אמפטי והרבה יותר "אנושי".

כמו כן, אם תלחצו על אייקון הרמקול תוכלו לשמוע אותו מדבר בלייב את הטקסטים שהוא כותב ואף ניתן לבחור מבין 4 קולות. זה הופך את כל החוויה להרבה יותר זורמת, קלילה ואף טרפיוטית. ממש כמו שיחה קולחת עם אדם ולא עם מכונה. כמו כן, ה"דיבור" שלו מאוד מוצלח. יש לו "מצבי רוח", אינטונציות והמון רגש שמחזקות את חוויית השיחה.

ממליץ לכם לבקש ממנו להצחיק אתכם. אצלי למשל הוא פצח בסשן "בדיחות אבא" (או בדיחות קרש) שבאמת הצחיקו אותי! (ראו תמונה).

כן... הוא לא מושלם, אבל הוא מספקת חוויה אחרת. משהו פחות טכני ומקצועי ויותר רגשי ואישי. כרגע הוא יכול לדבר ולהבין רק אנגלית אך ממליץ לכם בחום לנסות אותו. חוויה נחמדה ביותר 🙂

רוצים לקבל עדכונים בלייב? רוצים מקום בו אתם יכולים להתייעץ עם מומחי AI, לשאול שאלות ולקבל תשובות? רוצים לשמוע על מבצעים והטבות לכלי ה-AI שמשנים את העולם? הצטרפו לקהילות ה-AI שלנו.

אפשר גם להרשם לניוזלטר שלנו

תוצאות נוספות...